Estudios e investigaciones

Impacto de la IA generativa en competencias digitales universitarias: evidencia experimental basada en el marco DigComp

Impact of generative AI on university students’ digital competences: experimental evidence based on the DigComp framework

Impacto de la IA generativa en competencias digitales universitarias: evidencia experimental basada en el marco DigComp

RIED-Revista Iberoamericana de Educación a Distancia, vol. 29, núm. 1, pp. 53-77, 2026

Asociación Iberoamericana de Educación Superior a Distancia

Esta obra está bajo una Licencia Creative Commons Atribución-NoComercial 4.0 Internacional.

Cómo citar: García, C. G., & Pallarés, N. (2026). Impact of generative

AI on university students’ digital competences: experimental evidence based on the DigComp framework

[Impacto de la IA generativa en competencias digitales universitarias: evidencia experimental basada en

el marco DigComp]. RIED-Revista Iberoamericana de Educación a Distancia,

29(1). https://doi.org/10.5944/ried.45533

Resumen: Este estudio analiza el impacto del uso formativo de inteligencia artificial (IA) generativa en el desarrollo de competencias digitales en estudiantes universitarios. La intervención se implementó mediante un ensayo controlado aleatorizado. El grupo experimental recibió formación orientada a utilizar estratégicamente modelos de IA generativa para la realización de tareas, mientras que el grupo de control completó las mismas actividades sin orientación específica sobre IA. El impacto se evaluó mediante un modelo de diferencias en diferencias con efectos fijos, basado en cuestionarios pre y postintervención. Las competencias se analizaron según el marco europeo DigComp 2.2, contemplándose cuatro áreas: alfabetización en información y datos, comunicación y colaboración, seguridad y resolución de problemas. Los resultados muestran mejoras estadísticamente significativas en alfabetización en información y datos y en resolución de problemas, tanto en su dimensión funcional como metacognitiva. Asimismo, se identificaron efectos diferenciales según el nivel inicial de competencia digital, siendo más pronunciados entre estudiantes con menor dominio previo, quienes presentan avances significativos en todas las competencias evaluadas. Estos hallazgos sugieren un efecto compensatorio del uso didáctico de la IA, capaz de reducir brechas y promover aprendizajes más equitativos. El estudio respalda la integración guiada de tecnologías emergentes en la educación superior para fortalecer las competencias digitales.

Palabras clave: inteligencia artificial, competencias digitales, educación superior, aprendizaje autónomo, DigComp.

Abstract: This study analyzes the impact of the formative use of generative artificial intelligence (AI) on the development of digital competencies in university students. The intervention was implemented through a randomized controlled trial research design. The experimental group received training aimed at strategically using generative AI models to complete academic tasks, while the control group carried out the same activities without specific AI guidance. The impact was assessed using a difference-in-differences model with fixed effects, based on pre- and post-intervention questionnaires. Competences were analyzed according to the European DigComp 2.2 framework, covering four main competence areas: information and data literacy, communication and collaboration, safety, and problem solving. The results show statistically significant improvements in information and data literacy and in problem solving, both in their functional and metacognitive dimensions. Differential effects were also identified depending on the initial level of digital competence, with more pronounced gains among students with lower prior proficiency, who showed significant progress across all evaluated competencies. These findings suggest a compensatory effect of the didactic use of AI, capable of reducing gaps and promoting more equitable and inclusive learning processes. The study supports the guided integration of emerging technologies in higher education to strengthen digital competencies.

Keywords: artificial intelligence, digital competences, higher education, autonomous learning, DigComp

INTRODUCCIÓN

La irrupción de herramientas basadas en inteligencia artificial (IA) generativa ha supuesto una transformación significativa en los procesos de enseñanza y aprendizaje en la educación superior (Hwang et al., 2020; Lee et al., 2024). Estas herramientas han reconfigurado las formas en las que los estudiantes acceden, analizan y evalúan la información, pudiendo influir en la mejora de sus competencias digitales. En este contexto, y ante la creciente adopción de estas tecnologías, resulta fundamental analizar sus efectos, particularmente en las competencias digitales, elemento clave para afrontar las exigencias de un mercado laboral en permanente transformación (Van Laar et al., 2020).

Estas competencias comprenden el conjunto de conocimientos y habilidades necesarios para utilizar de manera efectiva las tecnologías digitales (Ferrari y Punie, 2013; Laupichler et al., 2022). Actualmente, incluyen no solo la búsqueda y gestión de información, sino también la capacidad de comprender y evaluar críticamente fuentes digitales (Polizzi, 2020). Estudios previos han señalado su importancia en diversos ámbitos como la educación, el empleo y las relaciones sociales (Bastian et al., 2023; Buchholz et al., 2020; Morgan et al., 2022). A su vez, la Comisión Europea las define como una de las ocho competencias clave para el aprendizaje permanente, subrayando su papel en el uso seguro, crítico y responsable de las tecnologías digitales para el aprendizaje, el trabajo y la participación activa en la sociedad (Comisión Europea, 2019). Por ello, promover su desarrollo se ha consolidado como una prioridad en las agendas educativas y políticas.

Investigaciones recientes han demostrado que la incorporación de tecnologías con fines educativos favorece el desarrollo de las competencias digitales, así como la autorregulación y una percepción positiva del aprendizaje por parte del estudiantado (Blau et al., 2020; Lin et al., 2025). Además, cuando estas tecnologías se integran de forma intencional y con una orientación clara, no solo fortalecen dichas competencias, sino que también pueden contribuir al aprendizaje autónomo (Ting, 2015). En la misma línea, Prior et al. (2016) muestran que un mayor nivel de competencias digitales, junto con actitudes positivas hacia la tecnología, se asocia con niveles más altos de autoeficacia, lo que incide positivamente en el aprendizaje autónomo y la participación.

El uso de herramientas de IA generativa en la educación superior ha sido ampliamente investigado, destacándose tanto sus beneficios como los riesgos asociados (Dimitriadou y Lanitis, 2023; Zhai et al., 2021). García Peñalvo et al. (2024) destacan que, si bien las herramientas de IA generativa ofrecen importantes beneficios, como la personalización del aprendizaje, la automatización de tareas repetitivas, la generación de contenidos educativos y el apoyo al desarrollo del pensamiento crítico, también presentan limitaciones significativas. Asimismo, se señalan desafíos vinculados a la equidad en el acceso, la protección de datos personales, y la necesidad de formar tanto a docentes como a estudiantes en un uso ético y crítico de estas tecnologías. Popenici y Kerr (2017) señalan que la incorporación de tecnologías basadas en inteligencia artificial está transformando profundamente los procesos de enseñanza y aprendizaje en las universidades, lo que plantea nuevos desafíos para las instituciones y requiere una revisión de los enfoques tradicionales.

Pese al creciente interés, son escasos los estudios que analizan de manera directa cómo el uso formativo de la IA generativa contribuye al desarrollo de competencias digitales. Una revisión sistemática conducida por Zhao et al. (2021), que analizó 33 artículos publicados entre 2015 y 2021, revela que apenas un 15 % de los trabajos publicados examina factores que pueden influir en su adquisición. Por el contrario, las investigaciones recientes se han enfocado en la relación inversa: cómo un mayor nivel de competencia digital favorece la adopción de estas tecnologías. En concreto, Moravec et al. (2024) muestran que un mayor nivel de competencias digitales se asocia con un uso más frecuente de ChatGPT para realizar pruebas, entretenimiento y adquisición de nuevos conocimientos. De forma complementaria, estudios recientes han encontrado que una mayor alfabetización digital se asocia con actitudes más favorables hacia el uso de tecnologías impulsadas por IA en contextos educativos (Saklaki y Gardikiotis, 2024), lo que refuerza la idea de una interacción dinámica entre competencias y disposición tecnológica. Si bien algunos de los trabajos recientes ofrecen perspectivas valiosas sobre las habilidades necesarias en entornos mediados por inteligencia artificial, persiste una escasez de investigaciones que evalúen de forma sistemática y estructurada la adquisición de competencias digitales específicas entre el alumnado universitario, utilizando marcos estandarizados como el DigComp.

Este estudio realiza tres aportes principales. En primer lugar, ofrece, según nuestro conocimiento, el primer análisis empírico del impacto de la integración didáctica de la IA generativa en el desarrollo de competencias digitales específicas dentro del marco DigComp, a partir de un diseño cuasiexperimental. En segundo lugar, cuantifica la magnitud de este impacto, identificando avances significativos en aspectos fundamentales como la autorregulación digital y la interacción con herramientas tecnológicas. En tercer lugar, al analizar efectos heterogéneos, revela un potencial efecto nivelador: los mayores avances se observan entre estudiantes con niveles iniciales más bajos, lo que sugiere que, aplicada con intencionalidad didáctica, la IA generativa puede contribuir a una mayor equidad en el desarrollo de competencias digitales.

Los resultados evidencian que una implementación didáctica intencionada de la IA generativa puede no solo potenciar el aprendizaje, sino también reducir desigualdades preexistentes. Su uso estratégico contribuye a construir entornos más equitativos e inclusivos, reforzando competencias clave para desenvolverse de forma crítica y autónoma en escenarios digitales cada vez más complejos.

El resto del artículo se estructura en cinco apartados. Primero, se revisa la literatura relevante sobre competencias digitales y el uso de IA generativa en contextos educativos. A continuación, se describe la metodología empleada, que comprende el diseño experimental y la estrategia de estimación, basada en un modelo de diferencias en diferencias con efectos fijos. Luego, se describen los datos utilizados y se ofrece un análisis descriptivo. En el apartado siguiente, se exponen y discuten los principales resultados, considerando tanto los efectos promedio como los efectos heterogéneos. Finalmente, se concluye con una reflexión sobre las implicaciones derivadas de los hallazgos.

REVISIÓN DE LA LITERATURA

El desarrollo de competencias digitales se ha convertido en un requisito indispensable para afrontar los retos y beneficiarse de las posibilidades que ofrece un entorno cada vez más digitalizado. En el ámbito educativo, resulta esencial que los estudiantes adquieran estas competencias, ya que la capacidad de utilizar eficazmente las tecnologías y acceder a la información constituye un factor clave para su éxito académico, así como para su desempeño profesional y personal (OECD, 2023).

Esta necesidad adquiere especial relevancia en la educación superior, donde los estudiantes son comúnmente denominados “nativos digitales” (Prensky, 2001), bajo la premisa de que, al haber crecido en entornos digitales, poseen habilidades innatas en el uso de herramientas tecnológicas. Sin embargo, pertenecer a esta generación no garantiza un uso competente, crítico ni orientado al aprendizaje, como han señalado diversos estudios (Gallardo-Echenique et al., 2015; Li y Ranieri, 2010; Ng, 2012; Selwyn, 2009). Esto pone de relieve la importancia de formar a los estudiantes en competencias digitales que les permitan adaptarse activamente a un entorno tecnológico en constante evolución y desarrollar una actitud abierta frente a la innovación (Barak, 2018). Por ello, el profesorado debe fomentar activamente el fortalecimiento de estas competencias con el fin de favorecer el aprendizaje de los estudiantes y aprovechar el potencial educativo que ofrecen las tecnologías digitales.

En este contexto, el concepto de competencia digital ha sido ampliamente abordado en la literatura especializada, dando lugar a una diversidad de enfoques y definiciones. Entre las definiciones de competencias digitales más aceptadas en la actualidad, se encuentra aquella que las concibe como un conjunto interrelacionado de habilidades esenciales para desenvolverse con éxito en entornos digitales (List, 2019). Dicha concepción está presente en el Marco Europeo de Competencia Digital para la Ciudadanía (DigComp), desarrollado inicialmente por Ferrari y Punie (2013). Este marco define las competencias digitales como un conjunto de conocimientos, habilidades y actitudes que permiten a los ciudadanos utilizar de forma eficaz las tecnologías digitales para el trabajo, el aprendizaje y la participación social. El modelo identifica cinco áreas clave: alfabetización en información y datos, comunicación y colaboración, creación de contenido digital, seguridad y resolución de problemas, siendo la versión más reciente el DigComp 2.2 (Vuorikari et al., 2022).

Aunque numerosos estudios han adoptado el modelo DigComp como punto de referencia para la evaluación de competencias digitales en contextos universitarios, la mayoría se ha centrado en medir el nivel de dominio de los estudiantes. En contraste, son relativamente escasas las investigaciones que analizan el impacto de intervenciones didácticas en el desarrollo efectivo de estas competencias. Entre las contribuciones más relevantes en esta línea destaca el estudio de Gutiérrez Porlán y Serrano Sánchez (2016), que demuestra cómo una intervención didáctica mediada por tecnologías digitales puede potenciar significativamente las competencias en las cinco áreas del DigComp. Estos hallazgos refuerzan la importancia de integrar estrategias intencionadas y sostenidas para fomentar una alfabetización digital crítica y funcional.

A pesar del creciente interés y la rápida adopción de herramientas de IA generativa, la literatura empírica que examina su impacto en la mejora de las competencias digitales del alumnado universitario sigue siendo limitada. Kasneci et al. (2023) destacan la importancia de acompañar el uso de herramientas como ChatGPT con estrategias didácticas que promuevan la verificación crítica de la información, el uso de fuentes complementarias fiables y la integración de actividades orientadas al desarrollo cognitivo del alumnado. Además, el diseño de prompts eficaces, la interpretación contextualizada de las respuestas de la IA y la reflexión sobre su uso son elementos clave para lograr una interacción significativa con estas tecnologías (Lee y Palmer, 2025). Fomentar estas prácticas en el aula puede favorecer el fortalecimiento de las competencias digitales. Benvenuti et al. (2023) sostienen que la inteligencia artificial representa un recurso de gran valor para los docentes en la promoción de habilidades como la creatividad, el pensamiento crítico y la resolución de problemas. Por su parte, Arseven y Bal (2025) destacan que este potencial radica en su capacidad para facilitar procesos metacognitivos fundamentales para el desarrollo de dichas competencias; sin embargo, ambos advierten que las experiencias educativas que integran la IA con estos propósitos siguen siendo escasas en la literatura. En consecuencia, resulta pertinente analizar en qué medida una integración didáctica y estructurada de estas tecnologías contribuye al fortalecimiento de dichas competencias en los estudiantes.

Una primera aportación desde esta perspectiva es el trabajo de Dalgıç et al. (2024), que demuestra que la integración de ChatGPT en la educación tiene un impacto positivo tanto en los resultados de aprendizaje como en el desarrollo de las competencias digitales de los estudiantes. El estudio señala que la alfabetización digital es una variable mediadora esencial y que, para aprovechar plenamente las ventajas de la inteligencia artificial, los estudiantes deben poseer y fortalecer continuamente sus competencias digitales. Además, concluye que el uso de ChatGPT fomenta directamente habilidades como la búsqueda y análisis de información, la resolución de problemas y el aprendizaje en entornos virtuales, actuando así no solo como una herramienta que exige competencias digitales, sino también como un recurso que contribuye activamente a su desarrollo. Por ello, los autores enfatizan la importancia de que las instituciones educativas prioricen la formación en competencias digitales para maximizar el potencial de tecnologías avanzadas como ChatGPT. Una segunda aportación relevante es el estudio de Naamati-Schneider y Alt (2024), quienes afirman haber sido los primeros en evaluar empíricamente la hipótesis de que el uso de ChatGPT puede volver obsoletas determinadas competencias digitales al asumir tareas previamente realizadas por los estudiantes, en particular aquellas vinculadas con el acceso y el análisis de la información. No obstante, sus hallazgos también revelan que la incorporación de esta tecnología en el proceso educativo puede potenciar la competencia de evaluación crítica, al exigir que los estudiantes verifiquen la validez y fiabilidad de los contenidos generados por la IA.

El análisis de estudios previos evidencia una creciente necesidad de promover competencias digitales en la educación superior, al tiempo que revela una base empírica aún limitada sobre el impacto de las herramientas de inteligencia artificial generativa en su desarrollo, especialmente por la falta de un marco de referencia unificado que facilite la comparación entre estudios. Si bien estas tecnologías muestran un potencial considerable para fortalecer dichas competencias, su efectividad depende en gran medida de cómo se integran en el proceso de enseñanza y aprendizaje. En este contexto, la presente investigación se propone cuantificar el efecto de una intervención didáctica basada en IA generativa, con el objetivo de aportar evidencia sobre su contribución al desarrollo de las competencias digitales del alumnado universitario, dentro del marco DigComp, así como analizar sus posibles efectos heterogéneos.

METODOLOGÍA

Para evaluar el impacto del uso formativo de la inteligencia artificial generativa (IA) en el aprendizaje, llevamos a cabo un ensayo controlado aleatorizado (RCT, por sus siglas en inglés) con estudiantes matriculados en la asignatura de Microeconomía. Los estudiantes pertenecían a las titulaciones de Administración y Dirección de Empresas y de Marketing y Dirección Comercial de la Universidad Católica de Murcia. Ambos programas ofrecían la asignatura en dos modalidades: presencial y en línea. Además, en el programa de Administración de Empresas, la modalidad presencial estaba disponible tanto en español como en inglés. Así, se conformaron cinco grupos (aulas) en total: tres presenciales y dos en línea.

La asignación del tratamiento se realizó a nivel de grupo (aula), de manera que cada uno de los cinco grupos fue asignado en su totalidad al tratamiento o al grupo de control. La asignación aleatoria se estratificó por modalidad (presencial o en línea) para asegurar una distribución equitativa del tratamiento entre las modalidades.1

Para mantener un entorno de aprendizaje consistente en todas las modalidades, el profesorado estandarizó los materiales y métodos de enseñanza, y estableció un protocolo de evaluación con el fin de garantizar que todos los grupos recibieran un contenido idéntico del curso (materiales, recursos y actividades), impartido de manera uniforme y evaluado con los mismos criterios, independientemente del programa. Todo el material del curso estuvo disponible a través de CANVAS, la plataforma institucional de la universidad.

La intervención constó de dos componentes: (1) una formación orientada a la aplicación estratégica de modelos de IA generativa, ofrecida únicamente al grupo de tratamiento, y (2) una serie de autoevaluaciones en línea, aplicadas a ambos grupos, compuestas por preguntas de opción múltiple que cubrían tanto los contenidos teóricos como prácticos de cada unidad del curso. Las autoevaluaciones incluían retroalimentación inmediata, la cual fue diferenciada según el grupo asignado.

La formación se centró en técnicas de elaboración de prompts eficaces y en el uso de modelos de lenguaje de gran escala (LLMs, por sus siglas en inglés) potenciados por IA, con el objetivo general de mejorar el aprendizaje y las competencias digitales de los estudiantes. Para ello, se plantearon los siguientes objetivos específicos, orientados a promover una interacción efectiva con los LLMs:

- Contextualizar la pregunta - Fomentar que los estudiantes describan el problema completo antes de formular preguntas específicas.

- Definir términos y variables clave - Enseñar a los estudiantes a expresar de manera explícita los principios económicos, fórmulas o supuestos relevantes a sus consultas.

- Descomponer problemas complejos - Aconsejar a estructurar las consultas en segmentos paso a paso para obtener respuestas más organizadas.

- Usar preguntas iterativas - resaltar la importancia de reformular, refinar y ampliar las respuestas generadas por la IA para profundizar la comprensión.

- Verificar sus propias soluciones - Fomentar que los estudiantes intenten resolver los problemas por sí mismos antes de recurrir a la IA.

Estos objetivos se abordaron en un taller formativo impartido exclusivamente al grupo de tratamiento durante el primer día de clase. La sesión se centró, principalmente, en el uso de ChatGPT, aunque también se presentaron brevemente otras herramientas, como Copilot y Gemini. El profesorado ofreció una explicación introductoria, acompañada de ejemplos prácticos, tras lo cual los estudiantes interactuaron por sí mismos con las herramientas y pudieron plantear sus dudas.

En las semanas posteriores, los estudiantes debían completar las autoevaluaciones en línea al finalizar cada unidad, a través de la plataforma Canvas del curso de Microeconomía. Cada prueba tenía un límite de tiempo de una hora y, al finalizar, los estudiantes recibían una calificación numérica. Se permitía un máximo de cinco intentos por evaluación, con un intervalo mínimo de un día entre ellos. En cada intento, las preguntas se generaban de forma aleatoria a partir del banco de ítems. La retroalimentación en las autoevaluaciones fue diseñada intencionalmente para diferenciarse entre los grupos de tratamiento. En el grupo tratado, la retroalimentación proporcionaba una guía paso a paso, con pistas y prompts personalizados alineados con los objetivos específicos enseñados para interactuar eficazmente con los LLMs. Esta retroalimentación formativa estaba diseñada para orientar al estudiantado hacia la respuesta correcta sin proporcionarla explícitamente, fomentando una comprensión más profunda y mejorando su capacidad de resolver problemas de forma autónoma. En lugar de indicar únicamente si la respuesta era correcta o incorrecta, la retroalimentación era adaptativa: los estudiantes podían interactuar con distintos componentes de la retroalimentación y personalizar su experiencia de aprendizaje según sus necesidades. Esto les permitía explorar explicaciones alternativas y refinar su comprensión según su rendimiento y brechas de aprendizaje. En cambio, los estudiantes del grupo de control recibieron únicamente una retroalimentación básica que indicaba si sus respuestas eran correctas o incorrectas, sin explicaciones, pistas ni recursos instruccionales adicionales. Los materiales y datos para replicar la intervención están disponibles en un repositorio abierto.2

Para evaluar el impacto de la intervención se administraron dos cuestionarios: uno el primer día de clase, antes del taller formativo en IA (pre), y otro tras la última autoevaluación (postintervención). Cada cuestionario incluía dos partes: (i) datos demográficos, familiares y de alfabetización económica3, y (ii) una evaluación de las competencias digitales autoinformadas por el estudiantado, basada en el marco desarrollado por Vuorikari et al. (2022). La primera versión de este marco, DigComp 1.0, fue elaborada por Ferrari y Punie (2013), con el objetivo de identificar y definir las competencias digitales relevantes para todos los ciudadanos que viven y trabajan en Europa. Actualmente, el modelo DigComp se ha consolidado como uno de los marcos de referencia más utilizados para el diseño de instrumentos de medición de competencias digitales en contextos universitarios (Mattar et al., 2022).

En la Tabla 1 se presenta una descripción detallada de los ítems respondidos por los estudiantes en relación con las competencias digitales evaluadas. Estas se alinearon con el modelo europeo DigComp 2.2 e incluyeron cuatro áreas clave: alfabetización en información y datos, comunicación y colaboración, seguridad, y resolución de problemas. En esta última, se evaluaron dos dimensiones: por un lado, la interacción con herramientas tecnológicas o dimensión funcional (Comp3), y por otro, la autorregulación digital, entendida como la capacidad de reflexionar metacognitivamente sobre el propio aprendizaje en entornos digitales (Comp4).

Competencias digitales evaluadas

| DigComp | Ítem | ||

| Área 1 | Alfabetización en información y datos | Comp1 | Identificar mis necesidades de información y encontrar datos y contenido a través de una búsqueda sencilla en entornos digitales, como por ejemplo Google. |

| Área 2 | Comunicación y colaboración | Comp2 | Lograr una comunicación efectiva utilizando herramientas digitales, como, por ejemplo, el correo electrónico, foros de discusión, etc. |

| Área 5 | Resolución de problemas | Comp3 | Dar instrucciones simples para que un sistema informático me ayude a resolver un problema o tarea básica, como, por ejemplo, bases de datos, software de hojas de cálculo, software de presentaciones, herramientas de IA, etc. |

| Resolución de problemas | Comp4 | Reconocer qué necesito mejorar o actualizar en mis competencias digitales. | |

| Área 4 | Seguridad | Comp5 | Evaluar los beneficios y riesgos antes de permitir que terceros procesen datos personales cuando utilizo entornos digitales o herramientas de IA. |

Los ítems, redactados en formato de autoinforme y con opciones cerradas, comenzaban con “soy capaz de...”, para evaluar el nivel de habilidad percibida. Se formularon de forma neutral, de modo que la respuesta indicara el grado de dominio sin inducir dificultad (Clifford et al., 2020). Para su elaboración, se tomaron como base las definiciones y ejemplos del marco DigComp 2.2, adaptados a los objetivos del estudio. Además, se optó por incluir solo cinco ítems para medir las competencias digitales, con el fin de evitar que el cuestionario resultara excesivamente extenso, reduciendo así el riesgo de abandono y favoreciendo la calidad de las respuestas, una estrategia recomendada en este ámbito (Vuorikari et al., 2025).

Los estudiantes valoraron su grado de acuerdo con cada afirmación mediante una escala Likert de 1 a 5, donde 1 correspondía al nivel más bajo (básico) y 5 al más alto (avanzado). Este formato, basado en ítems autoinformados, es uno de los métodos más utilizados para medir la competencia digital (Laanpere, 2019).

La fiabilidad del instrumento se estimó mediante los coeficientes alfa de Cronbach y omega de McDonald, que arrojaron los mismos valores tanto en el pretest (0.75) como en el postest (0.80). Estos coeficientes indican una consistencia interna aceptable en la medición inicial y buena tras la intervención (Hair et al., 2010).

Método de estimación

La estimación se basa en un experimento aleatorizado combinado con un modelo de diferencias en diferencias (DiD) con efectos fijos. En primer lugar, la aleatorización permite asignar a los participantes al grupo de tratamiento y al grupo de control de forma exógena, lo que garantiza la comparabilidad y minimiza los sesgos de selección. A partir de esta asignación, se implementó una estrategia de diferencias en diferencias que compara la evolución del nivel de competencia entre ambos grupos antes y después de la intervención.

Dado que la asignación del tratamiento fue a nivel de grupo (aula), los errores estándar se agruparon en esa unidad. Para corregir posibles sesgos derivados del reducido número de clusters (cinco), la significatividad estadística se evaluó mediante el método wild cluster bootstrap-t, como se detalla en la sección de robustez.

La especificación econométrica es la siguiente:

Yit = δ(Treati × Postt) + βPostt + γi + ϵit

Donde:

- Yit: variable ficticia que toma el valor 1 si el estudiante reporta el nivel máximo (valor 5) en la competencia analizada.

- Treati×Postt: interacción entre Treati y Postt.

- Treati: variable ficticia que toma valor 1 si el estudiante está en el grupo de tratamiento.

- Postt: dummy que toma valor 1 para las observaciones posteriores a la intervención (cuestionario final).

- γi: efectos fijos individuales.

La dicotomización de la variable dependiente facilita una interpretación más directa del efecto del tratamiento, al centrarse en la probabilidad de alcanzar el valor 5, entendido como un umbral claro y exigente de competencia plena. Esta definición atenúa sesgos de deseabilidad social al exigir la respuesta máxima, filtrando así posibles sobreestimaciones moderadas. Aunque supone una pérdida parcial de varianza, la robustez de los resultados se contrasta con modelos ordinales (logit ordinal), presentados en la sección correspondiente.

Características iniciales

| Variable |

(1) Todos |

(2) Tratados |

(3) Control |

(4) P-valor(2)-(3) |

| A. Características del Estudiante | ||||

| Mujer | 0.355 | 0.356 | 0.354 | 0.968 |

| (0.037) | (0.047) | (0.060) | ||

| Edad | 20.911 | 20.808 | 21.077 | 0.823 |

| (0.328) | (0.452) | (0.453) | ||

| (Edad)^2 | 455.325 | 454.039 | 457.385 | 0.962 |

| (20.568) | (29.661) | (24.936) | ||

| Trabaja | 0.266 | 0.269 | 0.262 | 0.903 |

| (0.034) | (0.044) | (0.055) | ||

| Estudiante de intercambio | 0.053 | 0.058 | 0.046 | 0.691 |

| (0.017) | (0.023) | (0.026) | ||

| Estudiante repetidor | 0.077 | 0.096 | 0.046 | 0.360 |

| (0.021) | (0.029) | (0.026) | ||

| Estudiante online | 0.089 | 0.067 | 0.123 | 0.760 |

| (0.022) | (0.025) | (0.041) | ||

| Nacional de un país occidental | 0.716 | 0.625 | 0.862 | 0.512 |

| (0.035) | (0.048) | (0.043) | ||

| Alfabetización económica pre-curso | 3.840 | 3.875 | 3.785 | 0.800 |

| (0.14) | (0.176) | (0.232) | ||

| Competencia digital pre-curso4 | 0.000 | -0.297 | 0.475 | 0.141 |

| (0.123) | (0.155) | (0.189) | ||

| B. Características del Hogar | ||||

| Renta <20000€ | 0.095 | 0.096 | 0.092 | 0.853 |

| (0.023) | (0.029) | (0.036) | ||

| Renta 20000-40000€ | 0.243 | 0.269 | 0.2 | 0.124 |

| (0.033) | (0.044) | (0.055) | ||

| Renta 40000-60000€ | 0.266 | 0.269 | 0.262 | 0.846 |

| (0.034) | (0.044) | (0.055) | ||

| Renta >60000€ | 0.32 | 0.288 | 0.369 | 0.548 |

| (0.036) | (0.045) | (0.06) | ||

| Madre - Educación Primaria | 0.065 | 0.087 | 0.031 | 0.301 |

| (0.019) | (0.028) | (0.022) | ||

| Madre - Educación Secundaria | 0.420 | 0.337 | 0.554 | 0.118 |

| (0.038) | (0.047) | (0.062) | ||

| Madre - Educación Terciaria | 0.515 | 0.577 | 0.415 | 0.157 |

| (0.039) | (0.049) | (0.062) | ||

| Padre - Educación Primaria | 0.065 | 0.077 | 0.046 | 0.467 |

| (0.019) | (0.026) | (0.026) | ||

| Padre - Educación Secundaria | 0.432 | 0.394 | 0.492 | 0.534 |

| (0.038) | (0.048) | (0.062) | ||

| Padre - Educación Terciaria | 0.503 | 0.529 | 0.462 | 0.652 |

| (0.039) | (0.049) | (0.062) | ||

| Observaciones | 169 | 104 | 65 | |

DATOS Y ESTADÍSTICOS DESCRIPTIVOS

Tal y como se ha descrito en la sección anterior, los datos utilizados provienen de dos encuestas llevadas a cabo antes y después de la intervención5. La Tabla 2 presenta las características iniciales de los estudiantes designados de forma aleatoria a los grupos de tratamiento y control. El total de la muestra lo conforman 169 estudiantes de los cuales 104 fueron asignados aleatoriamente al grupo de tratamiento y 65 al grupo de control según el grupo (aula) al que pertenecían. No se detectan diferencias estadísticamente significativas entre los grupos en ninguna de las variables demográficas, académicas o socioeconómicas consideradas, lo cual sugiere que el proceso de aleatorización fue apropiado y hay un balance adecuado en las condiciones iniciales.

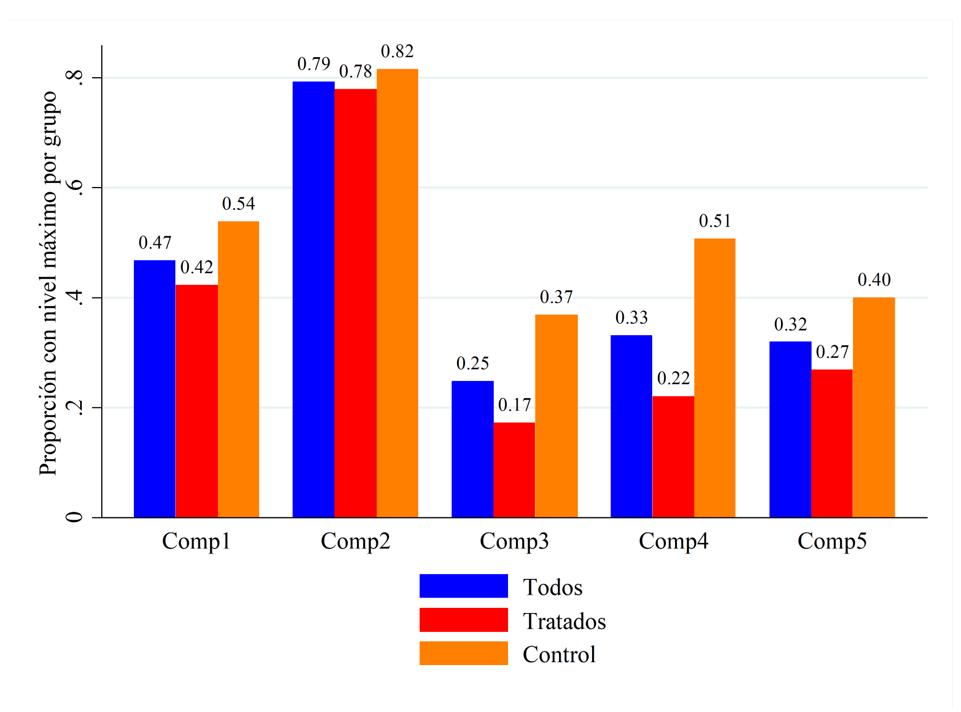

Proporción de estudiantes con nivel máximo (valor 5) en competencias digitales antes de la intervención

De forma complementaria, el análisis por dimensiones presentado en la Figura 1 revela que los niveles iniciales de competencia eran heterogéneos entre áreas. Las proporciones de estudiantes que reportaron haber alcanzado el nivel máximo (valor 5) oscilaron entre 0.25 (Comp3) y 0.79 (Comp2) en el total de la muestra, y entre el 0.17 y el 0.78, respectivamente, dentro del grupo de tratamiento. Esto indica un margen considerable para la mejora, especialmente en dimensiones funcionales como la interacción con herramientas tecnológicas (Comp3), así como en áreas metacognitivas relacionadas con las habilidades de autorregulación digital (Comp4) o con la toma de decisiones informadas en seguridad digital (Comp5). Tal como señalan estudios previos, niveles bajos de competencia digital general suelen asociarse con menor confianza y práctica en seguridad digital (Tomczyk, 2020), lo que podría contribuir a explicar los valores relativamente más bajos en estas dimensiones.

RESULTADOS Y DISCUSIÓN

Los modelos estimados emplean una variable dependiente dicotómica que indica si el estudiante alcanzó el nivel más alto de competencia digital, lo que permite interpretar los coeficientes (multiplicados por 100) como cambios en la probabilidad, en puntos porcentuales (p.p.), de alcanzar dicho nivel.

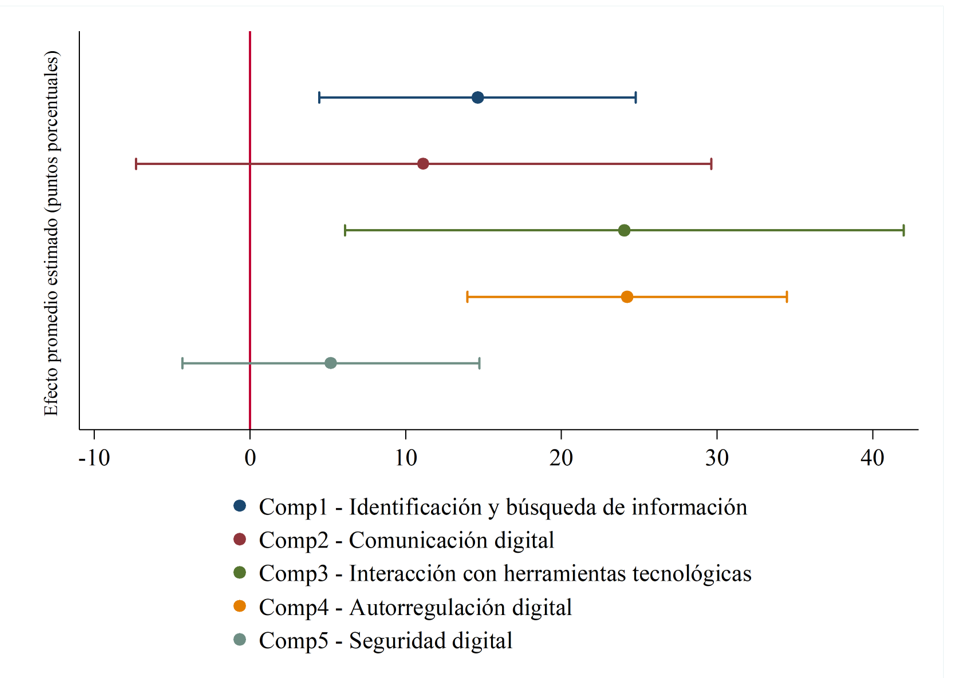

La Figura 2 ilustra de forma visual los efectos promedio estimados del tratamiento sobre la probabilidad de alcanzar el nivel más alto de competencia digital. Se observa con claridad que las mayores ganancias se concentran en las dimensiones de autorregulación digital (Comp4) e interacción con herramientas tecnológicas (Comp3), seguidas por la competencia en identificación y búsqueda de información (Comp1). En cambio, las competencias asociadas a la comunicación digital (Comp2) y la seguridad digital (Comp5) muestran estimaciones positivas, aunque con menor magnitud y mayor incertidumbre estadística. Esta representación gráfica ofrece una visualización integrada de la magnitud y la precisión estadística de los efectos estimados para cada competencia.

Estos resultados se corresponden con los coeficientes presentados en la Tabla 3, donde se confirma un impacto positivo y significativo del tratamiento en tres de las cinco dimensiones analizadas: Comp1, Comp3 y Comp4. El impacto más fuerte se observa en Comp3 y Comp4, con aumentos de 24 p.p., seguidos por Comp1 con un incremento de 14.6 p.p. En contraste, las competencias ligadas a la comunicación digital (Comp2) y la seguridad digital (Comp5) presentan efectos positivos, pero no significativos a nivel promedio, aunque sí emergen patrones diferenciados cuando se considera el nivel competencial inicial.

Para explorar la existencia de efectos distributivos, se estimaron modelos con interacciones basadas en una variable indicadora que identifica al alumnado cuya competencia digital inicial estaba por encima de la mediana (Q2). Los resultados revelan heterogeneidad en los impactos6, con los beneficios más pronunciados concentrados en el subgrupo con niveles iniciales bajos (es decir, por debajo de la mediana), tal y como muestra el Panel B de la Tabla 3. En estudiantes con menor nivel de competencia digital inicial, se observaron mejoras significativas en todas las competencias, con incrementos que oscilan entre los 18 y 38 p.p. En cambio, entre quienes tenían mayor competencia digital inicial, los efectos estadísticamente significativos fueron positivos en el caso de la autorregulación digital (Comp4) con un efecto de 14 p.p., pero negativos en el caso de la seguridad digital (Comp5). Este resultado negativo podría reflejar un ajuste en la autoevaluación de los estudiantes con mayor nivel inicial, quienes tras la intervención podrían haber desarrollado una visión más crítica de sus propias competencias. Aunque el estudio no recoge evidencia empírica directa al respecto, este patrón es coherente con las implicaciones teóricas del efecto Dunning-Kruger, según el cual el aumento del conocimiento puede ir acompañado de una mayor conciencia sobre las propias limitaciones (Dunning, 2011; Kruger y Dunning, 1999).

Todo esto apunta a un efecto compensatorio de la intervención en el contexto estudiado, coherente con investigaciones que muestran cómo las tecnologías, implementadas con orientación didáctica, pueden reducir brechas y fomentar aprendizajes más equitativos.

Efectos promedio del tratamiento sobre la probabilidad de alcanzar el nivel más alto de competencia digital

Nota: coeficientes estimados de Treat*Post, en puntos porcentuales (por 100), con intervalos de confianza al 95 %. Corresponden con el Panel A de la Tabla 3.

Investigaciones recientes sobre IA generativa destacan su potencial para fortalecer competencias digitales. Naamati-Schneider y Alt (2024) evidencian que, en entornos estructurados como el aprendizaje basado en problemas, ChatGPT promueve habilidades como formular prompts eficaces y evaluar críticamente los resultados, subrayando que estas destrezas requieren una implementación didáctica deliberada. De lo contrario, las competencias digitales fundamentales podrían verse desatendidas. En la misma línea, Güner y Er (2025) observan que, sin orientación, los estudiantes utilizan ChatGPT de manera superficial, mientras que el entrenamiento en prompting y uso estratégico fomenta interacciones más reflexivas y autónomas. Finalmente, estudios experimentales y metaanálisis (Wang et al., 2025; Wang y Fan, 2025) confirman que el feedback personalizado de ChatGPT mejora motivación, reflexión y desempeño en tareas complejas, apoyando el desarrollo de habilidades cognitivas y digitales avanzadas.

Los hallazgos son especialmente relevantes por la mejora en competencias metacognitivas como la autorregulación digital (Comp4). Lin et al. (2025) señalan que el uso guiado de herramientas como ChatGPT facilita la planificación autónoma, la organización de ideas y la formulación de preguntas, al mitigar limitaciones de memoria de trabajo y estructuración de la información. Sin embargo, advierten que este apoyo puede generar dependencia del feedback automatizado, limitando la autonomía crítica. De ahí la necesidad de acompañar la IA con estrategias didácticas que promuevan una apropiación activa.

Aunque estudios como Hillmayr et al. (2020) se centran en niveles educativos inferiores, sus hallazgos sobre el efecto positivo de las tecnologías en autorregulación y resolución de problemas podrían extrapolarse al ámbito universitario, especialmente entre estudiantes con menor nivel de competencia.

El patrón observado en nuestros resultados, con mayores beneficios entre estudiantes con menor nivel inicial, sugiere que estas tecnologías, implementadas con intencionalidad didáctica, pueden desempeñar un papel compensatorio. Este efecto nivelador destaca en dimensiones clave como la autorregulación digital (Comp4) y la interacción con herramientas tecnológicas (Comp3), esenciales en contextos universitarios que demandan creciente autonomía y entornos orientados a la adquisición de competencias digitales vinculadas al empleo crítico de la IA. Ello coincide con la literatura que sostiene que la IA generativa, como apoyo personalizado, puede desempeñar funciones equivalentes a sistemas de tutoría inteligente sin reemplazar al docente (Hwang et al., 2020).

En el panorama educativo actual destaca la necesidad de reforzar competencias que permitan a los estudiantes adaptarse a entornos dinámicos e inciertos, especialmente las relacionadas con la resolución de problemas, consideradas clave para la formación continua (Csapó y Funke, 2017; OECD, 2013; Rahman, 2019).

Resultados de los modelos lineales de diferencias en diferencias con efectos fijos (Coeficientes estimados sobre la probabilidad de alcanzar el nivel más alto de competencia digital)

|

(1) Comp1 |

(2) Comp2 |

(3) Comp3 |

(4) Comp4 |

(5) Comp5 |

|

| A. Promedio | |||||

| Treat*Post | 0.146** | 0.112 | 0.240** | 0.242*** | 0.052 |

| (0.037) | (0.067) | (0.065) | (0.037) | (0.034) | |

| R2 | 0.017 | 0.012 | 0.055 | 0.038 | 0.004 |

| B. Competencias digitales pre-curso por encima de la mediana Q2 | |||||

| Treat*Post | 0.374*** | 0.209** | 0.294*** | 0.318*** | 0.178*** |

| (0.041) | (0.05) | (0.045) | (0.057) | (0.02) | |

| Treat*Post*Q2 | -0.539*** | -0.230* | -0.126 | -0.179 | -0.298*** |

| (0.105) | (0.108) | (0.082) | (0.095) | (0.009) | |

| Treat*Post+Treat*Post*Q2 | -0.165 | -0.021 | 0.168 | 0.139* | -0.12** |

| (0.092) | (0.133) | (0.097) | (0.065) | (0.027) | |

| R2 | 0.151 | 0.039 | 0.061 | 0.05 | 0.043 |

| N | 338 | 338 | 338 | 338 | 338 |

Robustez de los resultados

Para evaluar la robustez de los resultados de los modelos lineales DiD (Tabla 3), se estimaron modelos logit ordinales bajo la misma estrategia. Estos modelos, que consideran la naturaleza ordinal de la variable dependiente, permiten calcular efectos marginales sobre la probabilidad de alcanzar el nivel más alto de competencia digital (valor 5). Los resultados (Tabla 4) confirman la validez de las estimaciones al mostrar efectos consistentes.

En promedio (Panel A), el tratamiento muestra efectos positivos y significativos en todas las dimensiones (13-28 p.p.), especialmente en Comp4 y Comp3. Este patrón se acentúa entre estudiantes con menor nivel inicial (Panel B), que muestran mejoras más amplias (21-36 p.p.), mientras que los de nivel alto también se benefician, aunque en menor medida (17-27 p.p.). Las interacciones negativas y significativas refuerzan esta diferencia.

Las diferencias entre modelos responden al tratamiento de la variable dependiente: el modelo lineal opera sobre una versión dicotómica, mientras que el modelo ordinal considera toda la escala y capta efectos no lineales. Ambos coinciden en los patrones clave, con efectos positivos especialmente entre estudiantes con menor nivel inicial. El modelo lineal se prefiere por su claridad interpretativa y control de heterogeneidad no observada mediante efectos fijos.7 La coherencia entre enfoques refuerza la robustez de las conclusiones.

Resultados de los modelos logit ordinales de diferencias en diferencias (Efectos marginales sobre la probabilidad de alcanzar el nivel más alto de competencia digital)

|

(1) Comp1 |

(2) Comp2 |

(3) Comp3 |

(4) Comp4 |

(5) Comp5 |

|

| A. Promedio | |||||

| Treat*Post | 0.144*** | 0.126*** | 0.175*** | 0.281*** | 0.160*** |

| (0.000) | (0.002) | (0.008) | (0.003) | (0.008) | |

| R2 | 0.02 | 0.02 | 0.021 | 0.028 | 0.02 |

| B. Competencias digitales pre-curso por encima de la mediana Q2 | |||||

| Treat*Post | 0.211*** | 0.209*** | 0.227*** | 0.364*** | 0.302*** |

| (0.001) | (0.000) | (0.004) | (0.003) | (0.003) | |

| Treat*Post*Q2 | -0.247*** | -0.253*** | -0.151*** | -0.233*** | -0.330*** |

| (0.001) | (0.002) | (0.002) | (0.095) | (0.005) | |

| Treat*Post+Treat*Post*Q2 | 0.188*** | 0.170*** | 0.185*** | 0.273*** | 0.183*** |

| (0.011) | (0.012) | (0.009) | (0.008) | (0.017) | |

| R2 | 0.111 | 0.081 | 0.098 | 0.042 | 0.102 |

| N | 338 | 338 | 338 | 338 | 338 |

Además de la consistencia observada en los modelos alternativos (logit ordinal), se ha verificado la robustez de los resultados desde el punto de vista de la inferencia estadística. Como se detalla en la sección metodológica, dado que la asignación del tratamiento se realizó a nivel de grupo (aula), con un total de cinco clusters, la significatividad estadística de los coeficientes se evaluó mediante el método wild cluster bootstrap-t propuesto por Cameron et al. (2008), implementado con pesos de Webb (2014) y 1.000 repeticiones.8 Los resultados principales se mantienen estables con este procedimiento y las conclusiones generales no se ven afectadas, lo que respalda la validez de las estimaciones.

CONCLUSIONES Y RECOMENDACIONES

Este estudio aporta evidencia empírica sobre el impacto positivo de una intervención didáctica, centrada en el uso de inteligencia artificial generativa, orientada específicamente al desarrollo de competencias digitales en estudiantes universitarios. El análisis revela efectos promedio significativos en tres de las cinco dimensiones evaluadas del marco DigComp: identificación y búsqueda de información (Comp1), interacción con herramientas tecnológicas (Comp3) y autorregulación digital (Comp4), con incrementos que oscilan entre 14.6 y 24 p.p.

Estos avances no solo son relevantes por su magnitud, sino también por el tipo de competencias involucradas. En particular, el incremento en la “alfabetización informacional y de datos” (Comp1) destaca en un contexto donde la abundancia de contenidos generados por sistemas automatizados exige habilidades críticas para filtrar, verificar y contrastar información. Este hallazgo refuerza el papel central de esta competencia en los marcos de ciudadanía digital y aprendizaje autónomo propuestos por Vuorikari et al. (2025).

En lo que respecta a las competencias Comp3 y Comp4, los resultados reflejan mejoras significativas promedio tanto en el uso funcional de la tecnología como en la dimensión metacognitiva del aprendizaje digital. Estas competencias son especialmente críticas en contextos universitarios que demandan una creciente autonomía del estudiantado. Asimismo, el análisis de efectos heterogéneos revela un patrón consistente: los mayores beneficios se concentran entre quienes partían de niveles iniciales más bajos, lo que sugiere que la intervención tuvo un efecto nivelador. En estos casos, se observaron mejoras significativas en todas las competencias, lo que refuerza el potencial compensatorio de este tipo de estrategias.

Los hallazgos sugieren la necesidad de revisar la idea generalizada de que los estudiantes universitarios, por su familiaridad con la tecnología, poseen habilidades digitales desarrolladas. Tal como señalan investigaciones previas, ser “nativo digital” no garantiza un uso competente ni crítico de las herramientas tecnológicas. Por el contrario, los resultados apuntan a la necesidad de intervenciones didácticas explícitas, bien diseñadas y guiadas, que aborden de forma sistemática la adquisición de estas habilidades (Gallardo-Echenique et al., 2015; Ng, 2012).

En conjunto, el estudio contribuye al campo emergente sobre IA generativa en educación, al ofrecer evidencia cuantitativa sobre cómo su integración didáctica puede fortalecer tanto competencias funcionales como metacognitivas. Estos resultados respaldan el uso intencionado de tecnologías emergentes no solo como recurso didáctico, sino también como herramienta para reducir desigualdades y promover entornos de aprendizaje más equitativos e inclusivos en contextos similares, alineados con los principios del aprendizaje a lo largo de la vida y con los estándares europeos de competencias digitales.

Finalmente, los resultados subrayan la importancia de que el profesorado participe activamente en la incorporación didáctica de estas tecnologías. Esto exige docentes con competencias digitales sólidas y una actitud abierta al cambio, capaces de adaptar sus prácticas a contextos educativos en transformación (Inamorato dos Santos et al., 2023). Además, dado que su impacto varía en función del nivel inicial del estudiantado, su implementación debe guiarse por criterios didácticos que aseguren un uso eficaz, ético y orientado al cierre de brechas. Por lo tanto, aprovechar las posibilidades que ofrece la IA generativa en el ámbito educativo no solo implica introducir nuevas herramientas, sino repensar las condiciones en las que estas pueden contribuir a una formación más justa y adaptada a los desafíos del presente.

No obstante, estos resultados deben interpretarse considerando ciertas limitaciones. En primer lugar, la muestra se compone exclusivamente de estudiantes de una universidad, lo que limita la generalización de los hallazgos a otros contextos educativos. Futuras investigaciones podrían ampliar la muestra incluyendo diversas instituciones y asignaturas, lo que permitiría evaluar la transferibilidad y escalabilidad de la intervención. En segundo lugar, aunque la asignación al tratamiento fue aleatoria, se realizó a nivel de aula por razones didácticas y para evitar spillovers, lo que redujo el número de clústeres y podría implicar cierto riesgo de autoselección ex ante. Para afrontarlo, los análisis incorporaron inferencia basada en remuestreo, así como pruebas de balance previas (Tabla 2), que muestran una distribución equilibrada de características observables entre condiciones. Asimismo, se incluyeron efectos fijos individuales en los modelos de diferencias en diferencias para controlar posibles sesgos asociados a factores no observados invariables. Este enfoque refuerza la interpretación causal, aunque no sustituye la evidencia que podrían aportar estudios adicionales. En tercer lugar, las variables dependientes provienen de cuestionarios autoinformados, lo que puede introducir sesgos de percepción o deseabilidad social. Para reducir estos posibles sesgos, definimos la variable de interés de forma estricta (solo quienes reportaron el nivel máximo de competencia), con el fin de evitar sobreestimaciones moderadas. Futuros estudios podrían complementarse con medidas más objetivas, como rúbricas de desempeño o el análisis de artefactos digitales.

REFERENCIAS

Arseven, T. y Bal, M. (2025). Critical literacy in artificial intelligence-assisted writing instruction: A systematic review. Thinking Skills and Creativity, 57, 101850. https://doi.org/10.1016/j.tsc.2025.101850

Barak, M. (2018). Are digital natives open to change? Examining flexible thinking and resistance to change. Computers & Education, 121, 115-123. https://doi.org/10.1016/j.compedu.2018.01.016

Benvenuti, M., Cangelosi, A., Weinberger, A., Mazzoni, E., Benassi, M., Barbaresi, M. y Orsoni, M. (2023). Artificial intelligence and human behavioral development: A perspective on new skills and competences acquisition for the educational context. Computers in Human Behavior, 148, 107903. https://doi.org/10.1016/j.chb.2023.107903

Bastian, A., Liza, L. O. y Efastri, S. M. (2023). Revolutionizing education: How digital literacy is transforming inclusive classrooms in post-COVID-19. Journal of Public Health, 45(3), e609-e610. https://doi.org/10.1093/pubmed/fdad058

Blau, I., Shamir-Inbal, T. y Avdiel, O. (2020). How does the pedagogical design of a technology-enhanced collaborative academic course promote digital literacies, self-regulation, and perceived learning of students? The Internet and Higher Education, 45, 100722. https://doi.org/10.1016/j.iheduc.2019.100722

Buchholz, B. A., DeHart, J. y Moorman, G. (2020). Digital citizenship during a global pandemic: Moving beyond digital literacy. Journal of Adolescent & Adult Literacy, 64(1), 11-17. https://doi.org/10.1002/jaal.1076

Cameron, A. C., Gelbach, J. B. y Miller, D. L. (2008). Bootstrap-based improvements for inference with clustered errors. The Review of Economics and Statistics, 90(3), 414-427. https://doi.org/10.1162/rest.90.3.414

Clifford, I., Kluzer, S., Troia, S., Jakobsone, M., Zandbergs, U., Vuorikari, R., Punie, Y., Castaño-Muñoz, J., Mediavilla, C., O’Keeffe, W. y Cabrera, M. (2020). DigCompSAT: A self-reflection tool for the European Digital Competence Framework for citizens (JRC Technical Report). Publications Office of the European Union. https://doi.org/10.2760/77437

Comisión Europea, Dirección General de Educación, Juventud, Deporte y Cultura. (2019). Key competences for lifelong learning. Publications Office of the European Union. https://doi.org/10.2766/569540

Csapó, B. y Funke, J. (Eds.). (2017). The nature of problem solving: Using research to inspire 21st century learning. OECD Publishing. https://doi.org/10.1787/9789264273955-en

Dalgıç, A., Yaşar, E. y Demir, M. (2024). ChatGPT and learning outcomes in tourism education: The role of digital literacy and individualized learning. Journal of Hospitality, Leisure, Sport & Tourism Education, 34, 100481. https://doi.org/10.1016/j.jhlste.2024.100481

Dimitriadou, E. y Lanitis, A. (2023). A critical evaluation, challenges, and future perspectives of using artificial intelligence and emerging technologies in smart classrooms. Smart Learning Environments, 10(1), Article 12. https://doi.org/10.1186/s40561-023-00231-3

Dunning, D. (2011). The Dunning–Kruger effect: On being ignorant of one’s own ignorance. En J. M. Olson y M. P. Zanna (Eds.), Advances in Experimental Social Psychology (Vol. 44, pp. 247-296). https://doi.org/10.1016/B978-0-12-385522-0.00005-6

Ferrari, A. y Punie, Y. (2013). DIGCOMP: A framework for developing and understanding digital competence in Europe. Publications Office of the European Union. https://doi.org/10.2788/52966

Gallardo-Echenique, E. E., de Oliveira, J. M., Marqués-Molias, L., Esteve-Mon, F., Wang, Y. y Baker, R. (2015). Digital competence in the knowledge society. MERLOT Journal of Online Learning and Teaching, 11(1). https://jolt.merlot.org/vol11no1/Gallardo-Echenique_0315.pdf

García Peñalvo, F. J., Llorens-Largo, F. y Vidal, J. (2024). La nueva realidad de la educación ante los avances de la inteligencia artificial generativa. RIED-Revista Iberoamericana de Educación a Distancia, 27(1), 9-39. https://doi.org/10.5944/ried.27.1.37716

Greene, W. (2004). The behaviour of the maximum likelihood estimator of limited dependent variable models in the presence of fixed effects. The Econometrics Journal, 7(1), 98-119. https://doi.org/10.1111/j.1368-423X.2004.00123.x

Güner, H. y Er, E. (2025). AI in the classroom: Exploring students’ interaction with ChatGPT in programming learning. Education and Information Technologies, 30, 12681–12707. https://doi.org/10.1007/s10639-025-13337-7

Gutiérrez Porlán, I. y Serrano Sánchez, J. L. (2016). Evaluation and development of digital competence in future primary school teachers at the University of Murcia. Journal of New Approaches in Educational Research, 5(1), 51-56. https://doi.org/10.7821/naer.2016.1.152

Hair, J. F., Jr., Black, W. C., Babin, B. J. y Anderson, R. E. (2010). Multivariate data analysis (7ª ed.). Prentice Hall.

Hillmayr, D., Ziernwald, L., Reinhold, F., Hofer, S. I. y Reiss, K. M. (2020). The potential of digital tools to enhance mathematics and science learning in secondary schools: A context-specific meta-analysis. Computers & Education, 153, 103897. https://doi.org/10.1016/j.compedu.2020.103897

Hwang, G. J., Xie, H., Wah, B. W. y Gašević, D. (2020). Vision, challenges, roles and research issues of artificial intelligence in education. Computers and Education: Artificial Intelligence, 1, 100001. https://doi.org/10.1016/j.caeai.2020.100001

Inamorato dos Santos, A., Chinkes, E., Carvalho, M. A. G., Solórzano, C. M. V. y Marroni, L. S. (2023). The digital competence of academics in higher education: Is the glass half empty or half full? International Journal of Educational Technology in Higher Education, 20, Article 9. https://doi.org/10.1186/s41239-022-00376-0

Kasneci, E., Sessler, K., Küchemann, S., Bannert, M., Dementieva, D., Fischer, F., Gasser, U., Groh, G., Günnemann, S., Hüllermeier, E., Krusche, S., Kutyniok, G., Michaeli, T., Nerdel, C., Pfeffer, J., Poquet, O., Sailer, M., Schmidt, A., Seidel, T., … Kasneci, G. (2023). ChatGPT for good? On opportunities and challenges of large language models for education. Learning and Individual Differences, 103, 102274. https://doi.org/10.1016/j.lindif.2023.102274

Kruger, J. y Dunning, D. (1999). Unskilled and unaware of it: How difficulties in recognizing one’s own incompetence lead to inflated self-assessments. Journal of Personality and Social Psychology, 77(6), 1121-1134. https://doi.org/10.1037/0022-3514.77.6.1121

Laanpere, M. (2019). Recommendations on assessment tools for monitoring digital literacy within UNESCO’s Digital Literacy Global Framework (Information Paper No. 56; UIS/2019/LO/IP/56). UNESCO Institute for Statistics. https://unesdoc.unesco.org/ark:/48223/pf0000366740

Laupichler, M. C., Aster, A., Schirch, J. y Raupach, T. (2022). Artificial intelligence literacy in higher and adult education: A scoping literature review. Computers and Education: Artificial Intelligence, 3, 100101. https://doi.org/10.1016/j.caeai.2022.100101

Lee, D. y Palmer, E. (2025). Prompt engineering in higher education: A systematic review to help inform curricula. International Journal of Educational Technology in Higher Education, 22, Article 7. https://doi.org/10.1186/s41239-025-00503-7

Lee, D., Arnold, M., Srivastava, A., Plastow, K., Strelan, P., Ploeckl, F., Lekkas, D. y Palmer, E. (2024). The impact of generative AI on higher education learning and teaching: A study of educators’ perspectives. Computers and Education: Artificial Intelligence, 6, 100221. https://doi.org/10.1016/j.caeai.2024.100221

Li, Y. y Ranieri, M. (2010). Are ‘digital natives’ really digitally competent?—A study on Chinese teenagers. British Journal of Educational Technology, 41(6), 1029-1042. https://doi.org/10.1111/j.1467-8535.2009.01053.x

Lin, C. J., Lee, H. Y., Wang, W. S., Huang, Y. M. y Wu, T. T. (2025). Enhancing reflective thinking in STEM education through experiential learning: The role of generative AI as a learning aid. Education and Information Technologies, 30(5), 6315-6337. https://doi.org/10.1007/s10639-024-13072-5

List, A. (2019). Defining digital literacy development: An examination of pre-service teachers’ beliefs. Computers & Education, 138, 146-158. https://doi.org/10.1016/j.compedu.2019.03.009

Mattar, J., Ramos, D. K. y Lucas, M. R. (2022). DigComp-based digital competence assessment tools: Literature review and instrument analysis. Education and Information Technologies, 27(8), 10843-10867. https://doi.org/10.1007/s10639-022-11034-3

Moravec, V., Hynek, N., Gavurová, B. y Rigelský, M. (2024). Who uses it and for what purpose? The role of digital literacy in ChatGPT adoption and utilisation. Journal of Innovation & Knowledge, 9(4), 100602. https://doi.org/10.1016/j.jik.2024.100602

Morgan, A., Sibson, R. y Jackson, D. (2022). Digital demand and digital deficit: Conceptualising digital literacy and gauging proficiency among higher education students. Journal of Higher Education Policy and Management, 44(3), 258-275. https://doi.org/10.1080/1360080X.2022.2030275

Naamati-Schneider, L. y Alt, D. (2024). Beyond digital literacy: The era of AI-powered assistants and evolving user skills. Education and Information Technologies, 29(16), 21263-21293. https://doi.org/10.1007/s10639-024-12694-z

Ng, W. (2012). Can we teach digital natives digital literacy? Computers & Education, 59(3), 1065-1078. https://doi.org/10.1016/j.compedu.2012.04.016

OECD. (2013). PISA 2012 assessment and analytical framework: Mathematics, reading, science, problem solving and financial literacy. OECD Publishing. https://doi.org/10.1787/9789264190511-en

OECD (2023). OECD Digital Education Outlook 2023: Towards an effective digital education ecosystem. OECD Publishing. https://doi.org/10.1787/c74f03de-en

Polizzi, G. (2020). Digital literacy and the national curriculum for England: Learning from how the experts engage with and evaluate online content. Computers & Education, 152, 103859. https://doi.org/10.1016/j.compedu.2020.103859

Popenici, S. A. D. y Kerr, S. (2017). Exploring the impact of artificial intelligence on teaching and learning in higher education. Research and Practice in Technology Enhanced Learning, 12(1), 22. https://doi.org/10.1186/s41039-017-0062-8

Prensky, M. (2001). Digital natives, digital immigrants. On the Horizon, 9(5), 1-6. https://doi.org/10.1108/10748120110424816

Prior, D. D., Mazanov, J., Meacheam, D., Heaslip, G. y Hanson, J. (2016). Attitude, digital literacy and self-efficacy: Flow-on effects for online learning behavior. The Internet and Higher Education, 29, 91-97. https://doi.org/10.1016/j.iheduc.2016.01.001

Rahman, M. M. (2019). 21st century skill “problem solving”: Defining the concept. Asian Journal of Interdisciplinary Research, 2(1), 64-74. https://doi.org/10.34256/ajir1917

Saklaki, A. y Gardikiotis, A. (2024). Exploring Greek students’ attitudes toward artificial intelligence: Relationships with AI ethics, media, and digital literacy. Societies, 14(12), 248. https://doi.org/10.3390/soc14120248

Selwyn, N. (2009). The digital native–myth and reality. Aslib Proceedings: New Information Perspectives, 61(4), 364-379. https://doi.org/10.1108/00012530910973776

Ting, Y.-L. (2015). Tapping into students’ digital literacy and designing negotiated learning to promote learner autonomy. The Internet and Higher Education, 26, 25-32. https://doi.org/10.1016/j.iheduc.2015.04.004

Tomczyk, Ł. (2020). Skills in the area of digital safety as a key component of digital literacy among teachers. Education and Information Technologies, 25(1), 471-486. https://doi.org/10.1007/s10639-019-09980-6

Van Laar, E., van Deursen, A. J. A. M., van Dijk, J. A. G. M. y de Haan, J. (2020). Determinants of 21st-century skills and 21st-century digital skills for workers: A systematic literature review. Sage Open, 10(1), 1-14. https://doi.org/10.1177/2158244019900176

Vuorikari, R., Kluzer, S. y Punie, Y. (2022). DigComp 2.2: The digital competence framework for citizens – with new examples of knowledge, skills and attitudes [EUR 31006 EN; JRC128415]. Publications Office of the European Union. https://doi.org/10.2760/115376

Vuorikari, R., Pokropek, A. y Castaño Muñoz, J. (2025). Enhancing digital skills assessment: Introducing compact tools for measuring digital competence. Technology, Knowledge and Learning. Advance online publication. https://doi.org/10.1007/s10758-025-09825-x

Walstad, W. B., Rebeck, K. y Butters, R. B. (2013). Test of Economic Literacy: Examiner’s manual (4ª ed.). Council for Economic Education. https://www.econedlink.org/wp-content/uploads/2018/09/TEL-Manual.pdf

Walstad, W. B., Watts, M. y Rebeck, K. (2007). Test of Understanding of College Economics: Examiner’s manual (4ª ed.). Council for Economic Education. https://www.econedlink.org/wp-content/uploads/2018/09/TUCE-4th.pdf

Wang, J. y Fan, W. (2025). The effect of ChatGPT on students’ learning performance, learning perception, and higher-order thinking: Insights from a meta-analysis. Humanities and Social Sciences Communications, 12, 621. https://doi.org/10.1057/s41599-025-04787-y

Wang, W.-S., Lin, C.-J., Lee, H.-Y., Huang, Y.-M. y Wu, T.-T. (2025). Integrating feedback mechanisms and ChatGPT for VR-based experiential learning: Impacts on reflective thinking and AIoT physical hands-on tasks. Interactive Learning Environments, 33(2), 1770-1787. https://doi.org/10.1080/10494820.2024.2375644

Webb, M. D. (2014). Reworking wild bootstrap based inference for clustered errors (QED Working Paper No. 1315). Queen’s University, Department of Economics. https://qed.econ.queensu.ca/working_papers/papers/qed_wp_1315.pdf

Zhai, X., Chu, X., Chai, C. S., Jong, M. S. Y., Istenič, A., Spector, J. M., Liu, J., Yuan, J. y Li, Y. (2021). A review of artificial intelligence (AI) in education from 2010 to 2020. Complexity, 2021, 8812542. https://doi.org/10.1155/2021/8812542

Zhao, Y., Pinto Llorente, A. M. y Sánchez Gómez, M. C. (2021). Digital competence in higher education research: A systematic literature review. Computers & Education, 168, 104212. https://doi.org/10.1016/j.compedu.2021.104212

Notas

Recibido: 01 Junio 2025

Aprobado: 09 Septiembre 2025

OnlineFirst: 24 Octubre 2025

Publicado: 01 Enero 2026