Estudios e investigaciones

AI-ED-SAT: diseño y validación de un cuestionario para autoevaluar competencias docentes en IA educativa

AI-ED-SAT: design and validation of a questionnaire for self-assessment of teaching skills in educational AI

AI-ED-SAT: diseño y validación de un cuestionario para autoevaluar competencias docentes en IA educativa

RIED-Revista Iberoamericana de Educación a Distancia, vol. 29, núm. 1, pp. 79-110, 2026

Asociación Iberoamericana de Educación Superior a Distancia

Esta obra está bajo una Licencia Creative Commons Atribución-NoComercial 4.0 Internacional.

Cómo citar: Sartor-Harada, A., & Azevedo Gomes, J. (2026). AI-ED-SAT:

design and validation of a questionnaire for self-assessment of teaching skills in educational AI

[AI-ED-SAT: diseño y validación de un cuestionario para autoevaluar competencias docentes en IA

educativa]. RIED-Revista Iberoamericana de Educación a Distancia, 29(1). https://doi.org/10.5944/ried.45413

Resumen: La integración acelerada de la Inteligencia Artificial (IA) en el ámbito educativo plantea nuevos retos para la formación y evaluación de competencias docentes. Este estudio presenta el diseño, validación y análisis psicométrico del cuestionario AI-ED-SAT, una herramienta de autoevaluación dirigida a docentes para diagnosticar su grado de preparación en el uso pedagógico, ético y curricular de la IA. Desarrollado bajo un enfoque de investigación basado en diseño (Design-Based Research), el instrumento se estructuró en torno a cuatro dimensiones alineadas con los actuales marcos de competencias en IA de la UNESCO (2024a, 2024b): comprensión conceptual de la IA, uso pedagógico de herramientas inteligentes, reflexión ética y crítica e integración curricular. Su construcción se apoyó en una revisión teórica exhaustiva y un proceso iterativo de validación mediante el método Delphi con 12 expertos en tecnología educativa, IA y formación docente. Posteriormente, en una prueba piloto a una muestra de 128 docentes de distintos niveles educativos, se analizó su fiabilidad (α de Cronbach = 0.93), validez de contenido y validez de constructo. Los resultados del análisis factorial exploratorio (AFE) confirmaron la agrupación de los ítems en cuatro factores teóricos, mientras que el análisis factorial confirmatorio (AFC) mostró índices de ajuste excelentes (CFI = 0.96; RMSEA = 0.045). El AI-ED-SAT se configura como una herramienta robusta y actualizada, útil tanto en la investigación como en programas de formación docente. Su enfoque autorreflexivo contribuye a fortalecer la alfabetización crítica y la agencia profesional del profesorado frente a los desafíos de la IA en la educación.

Palabras clave: inteligencia artificial, educación, competencias docentes, cuestionario, validación de instrumento.

Abstract: The accelerated integration of Artificial Intelligence (AI) in education poses new challenges for teacher training and assessment. This study presents the design, validation, and psychometric analysis of the AI-ED-SAT questionnaire, a self-assessment tool designed for teachers to diagnose their level of preparedness in the pedagogical, ethical, and curricular use of AI. The AI‑ED‑SAT questionnaire was validated within the Design‑Based Research approach. It comprises four dimensions aligned with UNESCO’s (2024a, 2024b) current AI competency frameworks: conceptual understanding of AI, pedagogical use of intelligent tools, ethical and critical reflection, and curricular integration. Its construction was based on an exhaustive theoretical review and an iterative validation process using the Delphi method with 12 experts in educational technology, AI, and teacher training. Subsequently, in a pilot test involving a sample of 128 teachers from various educational levels, the reliability (Cronbach’s α = 0.93), content validity, and construct validity were analyzed. The results of the exploratory factor analysis (EFA) confirmed the grouping of items into four theoretical factors, while the confirmatory factor analysis (CFA) showed excellent fit indices (CFI = 0.96; RMSEA = 0.045). The AI‑ED‑SAT is a robust and up‑to‑date tool that is useful in both research and teacher training programs. Its self-reflective approach helps strengthen teachers’ critical literacy and professional agency in the face of the challenges posed by AI in education.

Keywords: artificial intelligence, education, teacher competencies, questionnaire, instrument validation.

INTRODUCCIÓN

La irrupción de la Inteligencia Artificial (IA) en los ecosistemas educativos está transformando no solo las metodologías de enseñanza-aprendizaje, sino también los marcos de referencia éticos, pedagógicos y organizativos que rigen la práctica docente. Si bien los avances tecnológicos han potenciado el desarrollo de entornos virtuales adaptativos, sistemas de tutoría inteligente y procesos de evaluación automatizada, su implementación en contextos escolares exige una preparación docente específica, situada y reflexiva (Holmes et al., 2019; UNESCO, 2021; UNESCO, 2024b).

Más allá del acceso a dispositivos o plataformas digitales, se hace necesario que los profesionales de la educación desarrollen competencias críticas en IA, que les permitan comprender su funcionamiento, valorar sus implicaciones sociales y éticas, y diseñar prácticas pedagógicas coherentes con los principios de equidad, inclusión y sentido formativo. En este marco, las competencias docentes en IA deben ser entendidas como un conjunto multidimensional de conocimientos, habilidades y actitudes que van más allá de la alfabetización digital tradicional (Celik, 2023; Chen et al., 2020).

Sin embargo, la literatura evidencia una escasez de instrumentos específicos y validados que permitan evaluar estas competencias en relación con la IA de forma rigurosa, contextualizada y formativa. La mayoría de los modelos existentes se centran en indicadores genéricos de competencia digital, lo que limita su capacidad para abordar los desafíos particulares que plantea la integración de la IA en la educación (Zawacki-Richter et al., 2019). Este vacío dificulta tanto la investigación empírica como el diseño de programas de formación docente orientados a las nuevas demandas tecnológicas.

En respuesta a esta necesidad, el presente estudio presenta el diseño, validación y análisis psicométrico del AI-ED-SAT (Artificial Intelligence in Education – Self-Assessment Tool), un cuestionario de autoevaluación dirigido a docentes de distintos niveles educativos, con el propósito de diagnosticar su nivel de competencia en torno al uso de la IA en el ámbito escolar. El instrumento se estructura en torno a cuatro dimensiones clave –comprensión conceptual de la IA, uso pedagógico de herramientas, ética y consideraciones en el aula, e integración curricular– y se ha desarrollado mediante un enfoque metodológico mixto, combinando revisión teórica, validación por juicio de expertos (método Delphi) y análisis factorial (exploratorio y confirmatorio). Su objetivo es doble: ofrecer una herramienta rigurosa para la investigación educativa y, al mismo tiempo, servir como recurso formativo que promueva la reflexión profesional y la mejora continua del profesorado frente a los desafíos de la IA en la educación.

Aunque el cuestionario ha sido desarrollado íntegramente en castellano, se optó por mantener un acrónimo en inglés con el objetivo de facilitar su visibilidad y adopción en futuras investigaciones internacionales. Esta decisión responde a la creciente presencia del inglés como lengua vehicular en el campo de la IA educativa, lo que puede favorecer su inclusión en bases de datos académicas, redes de colaboración global y procesos de traducción y adaptación transcultural.

Educación y tecnologías emergentes: el nuevo paradigma docente

El avance de las tecnologías emergentes, y en particular de la IA, está reconfigurando profundamente el escenario educativo contemporáneo. Diversas investigaciones recientes subrayan la necesidad urgente de redefinir las competencias docentes ante esta transformación (Celik, 2023; Holmes et al., 2019; UNESCO, 2023). Lejos de limitarse al dominio técnico, estas competencias comprenden una comprensión crítica del impacto de la tecnología en los procesos de enseñanza-aprendizaje, el uso ético de los datos, la garantía de inclusión y el diseño de experiencias personalizadas y significativas.

La transformación digital ha generado cambios estructurales en la educación, afectando tanto a las herramientas disponibles como a las dinámicas pedagógicas, los marcos normativos y los roles profesionales del cuerpo docente. En este contexto, tecnologías como la realidad aumentada, el big data, el blockchain o la propia IA no solo abren nuevas posibilidades didácticas, sino que imponen la necesidad de una reconfiguración profunda de las competencias profesionales del profesorado (Bo, 2024; UNESCO, 2024b).

Este nuevo paradigma exige al docente desempeñar funciones más complejas: diseñador de experiencias de aprendizaje, mediador crítico entre tecnología y currículo, y gestor ético del conocimiento digital. En consecuencia, la integración tecnológica en el aula no puede reducirse a un uso instrumental o técnico, sino que requiere un enfoque pedagógico contextualizado, capaz de valorar sus implicaciones sociales, éticas y educativas, y adaptarlas a las necesidades y trayectorias del estudiantado (Cabero-Almenara et al., 2020).

Diversas iniciativas internacionales, como el marco DigCompEdu (Ghomi y Redecker, 2019) o las directrices de la UNESCO para la competencia docente en TIC y actualmente, las específicas para el uso de IA, han establecido referentes para el desarrollo de competencias digitales en el profesorado. No obstante, dichos marcos suelen adoptar una perspectiva generalista, centrada en habilidades transversales y tecnologías ya consolidadas, sin abordar con suficiente profundidad los desafíos específicos que plantean las tecnologías emergentes, y en particular, la IA. Esta limitación evidencia la necesidad de avanzar hacia modelos que integren dimensiones específicas de apropiación crítica de estas tecnologías, orientados a fomentar nuevas alfabetizaciones digitales que sitúen al docente como agente activo de transformación dentro de los ecosistemas educativos contemporáneos.

Aunque DigCompEdu (Ghomi y Redecker, 2019) constituye un marco ampliamente reconocido para evaluar la competencia digital docente, su orientación generalista lo limita para abordar en profundidad las particularidades de la Inteligencia Artificial. Este instrumento describe áreas competenciales transversales aplicables a diversas tecnologías digitales, sin diferenciar entre herramientas consolidadas y emergentes, ni integrar de forma explícita dimensiones éticas y curriculares específicas para la IA. En contraste, el AI-ED-SAT se focaliza exclusivamente en el uso educativo de la Inteligencia Artificial, incorporando indicadores vinculados a la comprensión conceptual de algoritmos, la aplicación pedagógica contextualizada, la reflexión ética y la integración curricular estratégica. De este modo, el AI-ED-SAT no pretende reemplazar a marcos como DigCompEdu, sino complementarlos, ofreciendo un nivel de detalle adaptado a los retos y oportunidades singulares que plantea la IA en los entornos educativos.

Inteligencia Artificial en la educación: potencial, riesgos y controversias

La incorporación de la Inteligencia Artificial en el ámbito educativo representa una de las transformaciones más significativas de los últimos años, con implicaciones directas en las prácticas docentes, los modelos pedagógicos y los procesos de enseñanza-aprendizaje. Su presencia se manifiesta en múltiples formas: sistemas de tutoría inteligente, plataformas adaptativas, análisis de aprendizaje, chatbots, motores de recomendación o herramientas de retroalimentación automatizada (Holmes et al., 2019; Zawacki-Richter et al., 2019).

Esta expansión tecnológica ofrece oportunidades relevantes para personalizar el aprendizaje, optimizar los procesos evaluativos y aliviar las tareas administrativas del profesorado. Sin embargo, también plantea desafíos sustanciales que no pueden ser ignorados. Entre ellos se encuentran los sesgos algorítmicos, la opacidad de los sistemas automatizados, la vulneración de la privacidad y el riesgo de delegar decisiones pedagógicas fundamentales a sistemas que operan con lógicas ajenas al juicio humano (Chesterman, 2021; Ferrante, 2021; Huang, 2023; Selwyn, 2019).

En este sentido, la IA no puede ser concebida únicamente como una herramienta funcional, sino como un fenómeno sociotécnico complejo, que implica decisiones políticas, pedagógicas y éticas (Flores Vivar y García Peñalvo, 2023). Su implementación educativa exige que el profesorado no solo adquiera habilidades operativas, sino que desarrolle también una alfabetización crítica que le permita comprender el funcionamiento de los algoritmos, identificar sus posibles sesgos y valorar sus implicaciones sociales y educativas (García Peñalvo et al., 2024; Lane et al., 2023; Luckin, 2017).

Un referente ético reciente y relevante es el Safe AI Education Manifesto (Alier Forment et al., 2024), que establece recomendaciones claras para el uso responsable de la IA en contextos educativos. Entre sus principios fundamentales se destacan la transparencia en los sistemas, la rendición de cuentas, la protección de la privacidad estudiantil, la promoción de la equidad y el fomento de una alfabetización crítica frente a las tecnologías algorítmicas. Estos principios refuerzan la dimensión ética del AI-ED-SAT, especialmente en los ítems relacionados con la identificación de sesgos, la toma de decisiones automatizada y los impactos educativos, contribuyendo a consolidar el instrumento como una herramienta integradora de principios éticos actualizados y relevantes para la práctica docente contemporánea.

A pesar de este panorama, la formación docente en IA continúa siendo incipiente. Las propuestas existentes suelen centrarse en aspectos instrumentales, sin incorporar una mirada integral que contemple tanto su dimensión pedagógica como ética (Delgado et al., 2024; Holmes y Tuomi, 2022). Ante este vacío, resulta fundamental diseñar instrumentos válidos y fiables que permitan evaluar no solo el grado de familiarización del profesorado con la IA, sino también su capacidad para integrarla de forma crítica, contextualizada y pedagógicamente significativa. Para ello, es necesario articular procesos metodológicos rigurosos, que combinen juicio experto con análisis estadísticos robustos, como proponen Sampieri (2018) y Muñiz y Fonseca-Pedrero (2019).

Competencias docentes en IA: más allá de la alfabetización digital

La irrupción de la Inteligencia Artificial (IA) en los entornos educativos ha consolidado su posición como tecnología disruptiva, con aplicaciones que abarcan desde la personalización del aprendizaje hasta la automatización de tareas evaluativas y administrativas (Holmes et al., 2019; Owan et al., 2023). Su implementación plantea retos importantes que exigen al profesorado una comprensión profunda de sus fundamentos técnicos y una reflexión crítica sobre los riesgos asociados, como los sesgos algorítmicos, la opacidad en la toma de decisiones, la dependencia tecnológica o las desigualdades en el acceso (Celik, 2023; Sharma et al., 2024).

En este contexto, el desarrollo de competencias específicas en IA se presenta como una prioridad estratégica para los sistemas educativos. A diferencia de las competencias digitales genéricas —centradas en la gestión de recursos digitales o entornos virtuales—, las competencias docentes en IA requieren una comprensión multidimensional que integre aspectos técnicos, éticos, pedagógicos y curriculares. Diversos documentos conceptuales han comenzado a elaborar este nuevo perfil competencial, entre ellos, los marcos de competencias en IA para docentes y estudiantes de la UNESCO (2024a, 2024b), el documento AI and the Future of Teaching de la UNESCO (2021), la actualización del marco DigCompEdu al contexto de IA (Caena y Redecker, 2019), y los estudios de Chen et al. (2020), Chiu et al. (2024) y Ng et al. (2023).

Khreisat et al. (2024) proponen una estructuración en cuatro ámbitos interrelacionados:

- 1. Comprensión de los principios y funcionamiento de la IA.

- 2. Capacidad de utilizar herramientas de IA con fines pedagógicos.

- 3. Conocimiento crítico sobre sus implicaciones éticas y sociales.

- 4. Integración curricular desde un enfoque interdisciplinario.

Esta propuesta refleja una concepción ampliada del rol docente, que trasciende el uso instrumental de la tecnología. En lugar de limitarse a operar herramientas, el docente debe posicionarse como un agente reflexivo y crítico, capaz de evaluar el sentido pedagógico, las consecuencias sociales y la pertinencia curricular de la IA en sus prácticas educativas. Tal como advierten Holmes et al. (2019), Zawacki-Richter et al. (2019) y Ayuso del Puerto y Gutiérrez Esteban (2022), muchos marcos existentes aún se mantienen en un plano descriptivo o eminentemente técnico, lo que limita su capacidad para orientar un desarrollo profesional auténticamente transformador.

Desde esta perspectiva, se hace necesaria la creación de instrumentos de evaluación que respondan a esta complejidad. Dichos instrumentos deben ir más allá de la medición del conocimiento declarativo, e incluir dimensiones como la competencia pedagógica, la disposición crítica y la integración curricular. El instrumento AI-ED-SAT, desarrollado en el marco de este estudio, se inscribe en esta lógica, al estructurarse en torno a cuatro dimensiones clave: comprensión conceptual, aplicación pedagógica, dimensión ética e integración curricular. Esta aproximación busca captar la complejidad del desarrollo profesional docente en la era de la IA, reconociendo la necesidad de una alfabetización crítica que permita a los educadores posicionarse activamente frente a los desafíos de las tecnologías emergentes.

Evaluación de competencias docentes: construcción y validación de instrumentos

En un contexto de transformación educativa impulsado por tecnologías emergentes, contar con instrumentos válidos y fiables para diagnosticar el nivel de competencia docente frente a la Inteligencia Artificial se vuelve crucial. La autoevaluación constituye, en este sentido, una estrategia formativa y reflexiva que permite identificar fortalezas y áreas de mejora desde una perspectiva situada (Panadero et al., 2019; Rachbauer et al., 2025).

Si bien existen numerosos instrumentos para medir la competencia digital docente (Cabero-Almenara et al., 2020; Ghomi y Redecker, 2019), la mayoría se enfoca en habilidades técnicas genéricas, sin abordar de manera específica las complejidades pedagógicas, éticas y curriculares que plantea la IA. Esta limitación ha generado una necesidad urgente de modelos evaluativos que capten no solo la familiaridad tecnológica del profesorado, sino también su capacidad de integrar la IA de forma crítica, contextualizada y pedagógicamente significativa (Celik, 2023; Delgado et al., 2024).

La construcción de instrumentos con estas características requiere un enfoque metodológico riguroso que combine criterios teóricos, empíricos y prácticos. En los últimos años, se ha consolidado una metodología mixta que incluye la revisión sistemática de literatura para la elaboración de ítems, la validación mediante juicio de expertos (como el método Delphi) y el análisis psicométrico (validez de contenido y constructo, fiabilidad interna) (Diefes-Dux et al., 2010; Muñiz y Fonseca-Pedrero, 2019; Sampieri, 2018). En este proceso, los enfoques participativos e interactivos, como la Design-Based Research (DBR), han demostrado ser especialmente útiles para garantizar la pertinencia semántica y pedagógica del instrumento.

La autoevaluación, además, se ha consolidado como una herramienta eficaz para fomentar la reflexión profesional, ofrecer datos para el diseño de planes formativos personalizados y promover la agencia docente (Borge et al., 2005). A diferencia de los modelos externos de evaluación, sitúa al profesorado como protagonista del diagnóstico y la mejora.

En este marco se inscribe el instrumento AI-ED-SAT, concebido para evaluar de manera integral las competencias docentes relacionadas con la IA en contextos educativos. Su desarrollo parte de una revisión crítica de la literatura especializada y de marcos de referencia recientes que abordan las implicaciones pedagógicas, éticas y curriculares de la IA (Celik, 2023; Holmes et al., 2019; Zawacki-Richter et al., 2019).

A partir de este análisis, se identificaron cuatro dimensiones clave que configuran un perfil competencial orientado a una apropiación crítica y formativa de la IA:

- 1.

Comprensión conceptual de la IA

Incluye conocimientos básicos sobre algoritmos, aprendizaje automático y sistemas adaptativos, con foco en sus aplicaciones educativas. Esta dimensión busca situar al docente como un actor informado frente a los discursos tecnológicos dominantes (Holmes et al., 2019).

- 2.

Uso pedagógico de herramientas de IA

Evalúa la capacidad de aplicar herramientas de IA con propósitos didácticos claros, considerando el nivel de los estudiantes y el contexto educativo. Incluye diseño de actividades, personalización del aprendizaje y evaluación automatizada, superando un uso meramente técnico (Chen et al., 2020).

- 3.

Ética y consideraciones críticas sobre IA

Abarca la identificación de riesgos como sesgos algorítmicos, problemas de privacidad o automatización de decisiones. Esta dimensión promueve una alfabetización crítica, posicionando al docente como mediador ético (Celik, 2023).

- 4.

Integración curricular de la IA

Mide la capacidad de incorporar la IA en la planificación didáctica y curricular, mediante proyectos interdisciplinarios, metodologías activas y adaptación a nuevos escenarios tecnológicos (Rachbauer et al., 2025).

Cabe señalar que, si bien algunas competencias pueden parecer solaparse —en particular entre el uso pedagógico de herramientas de IA y su integración curricular—, ambas se distinguen por su nivel de aplicación: mientras la segunda dimensión se refiere al uso didáctico en el aula (microplanificación), la cuarta se enfoca en la incorporación estratégica de la IA en la planificación curricular general (macroplanificación), incluyendo enfoques interdisciplinarios y alineación institucional. Esta diferenciación permite evitar ambigüedades y captar distintos niveles de apropiación docente.

Estas dimensiones se articulan de manera complementaria, permitiendo una evaluación holística del rol docente en el ecosistema digital. A diferencia de modelos fragmentarios o excesivamente técnicos, el AI-ED-SAT propone un marco integrado donde la acción pedagógica, el conocimiento conceptual, la visión curricular y el compromiso ético se entrelazan en un mismo dispositivo evaluativo.

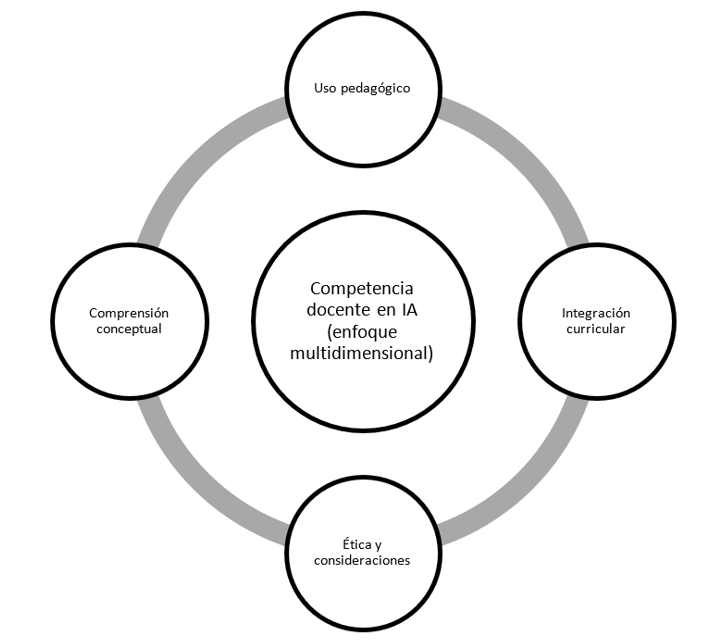

Esquema del instrumento

La Figura 1 presenta una representación esquemática del modelo AI-ED-SAT, destacando la interrelación entre sus dimensiones y su fundamento teórico. El orden gráfico de las dimensiones: Uso Pedagógico, Comprensión conceptual, Integración curricular y Ética y consideraciones no implica jerarquía, sino que refleja una disposición circular y no lineal que enfatiza su interdependencia. Las dimensiones del modelo no siguen un orden de adquisición predeterminado, sino que configuran un marco multidimensional que puede desarrollarse de forma paralela, complementaria o combinada, según el perfil del docente, su experiencia previa y el contexto educativo en el que se desempeñe.

En suma, la incorporación de la IA en el ámbito educativo exige una comprensión integral por parte del profesorado, que combine el dominio conceptual con una apropiación crítica, ética y pedagógica. Pese a los avances en la definición teórica de estas competencias, sigue existiendo una carencia de instrumentos específicos, válidos y fiables que permitan diagnosticar dichas competencias de manera rigurosa y contextualizada.

El AI-ED-SAT se concibe como una respuesta a esta necesidad. Su diseño metodológico, basado en la combinación de enfoques cualitativos y cuantitativos, incluyendo Design-Based Research, juicio de expertos y análisis factorial, busca asegurar la solidez teórica y psicométrica del instrumento, así como su utilidad formativa en la mejora de la práctica docente.

METODOLOGÍA

Diseño metodológico del instrumento

Este estudio se enmarca en un enfoque cuantitativo de alcance descriptivo y correlacional, orientado al diseño, validación y análisis psicométrico de un instrumento de autoevaluación docente sobre el uso de la Inteligencia Artificial (IA) en educación. Metodológicamente, se integraron los principios del Design-Based Research (DBR) (Brown, 1992) con las orientaciones actuales para la validación de instrumentos educativos (Muñiz y Fonseca-Pedrero, 2019; Sampieri, 2018).

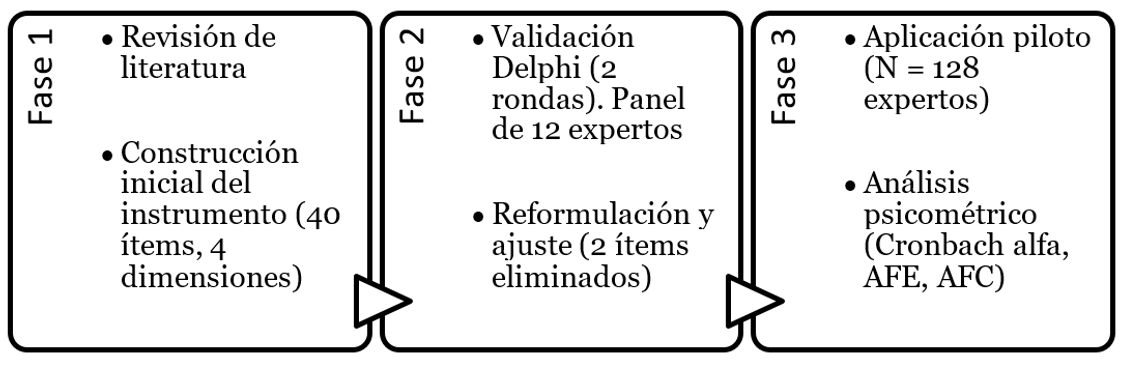

El proceso se estructuró en tres fases principales:

- 1. Construcción del cuestionario, a partir de una revisión sistemática de literatura reciente.

- 2. Validación de contenido mediante juicio de expertos, utilizando el método Delphi.

- 3. Aplicación piloto y análisis psicométrico del instrumento.

Etapas del proceso de elaboración y validación

Se llevó a cabo una prueba piloto a modo de intervención, en la que se aplicó el instrumento a individuos con características similares a la muestra objetivo. La finalidad de esta prueba fue ajustar aquellos ítems que pudieran requerir modificaciones en términos de operatividad, redacción u otros aspectos, así como optimizar la apariencia del instrumento (Hernández-Sampieri et al., 2006).

La revisión bibliográfica realizada sobre las competencias docentes en el uso de la Inteligencia Artificial (IA) en educación condujo a la configuración de la primera estructura del cuestionario de autoevaluación en torno a dos dimensiones fundamentales que cubren el espectro de análisis de la práctica docente: (1) la integración pedagógica de la IA en el aula y (2) la competencia docente en IA y su impacto en la enseñanza.

El primer borrador se construyó siguiendo un proceso fundamentado en la metodología basada en el diseño (DBR, por sus siglas en inglés) descrita por Brown (1992). El proceso se estructuró en tres fases: en la primera, se llevó a cabo una revisión de la literatura sobre IA en educación y competencias docentes en entornos digitales; en la segunda, se definieron las dimensiones y se elaboraron los ítems que compondrían el cuestionario; y en la tercera, se validó el instrumento mediante el método Delphi con un panel de expertos y el aprendizaje (Chen et al., 2020; Holmes et al., 2019; Luckin, 2017; UNESCO, 2024b).

El instrumento, denominado AI-ED-SAT (Artificial Intelligence in Education – Self-Assessment Tool), fue diseñado con el propósito de evaluar el nivel de competencia docente en cuatro dimensiones clave:

- 1. Conocimientos generales sobre IA y su aplicación educativa

- 2. Uso pedagógico de herramientas de IA

- 3. Ética y consideraciones sobre IA en el aula

- 4. Integración curricular de la IA

Se elaboraron inicialmente 40 ítems, redactados como afirmaciones, y distribuidos equitativamente en las cuatro dimensiones (10 ítems por dimensión). Las respuestas se estructuraron en una escala de Likert de 5 puntos:

1 = Muy en desacuerdo | 2 = En desacuerdo | 3 = Ni de acuerdo ni en desacuerdo | 4 = De acuerdo | 5 = Muy de acuerdo

La decisión de incluir un número equilibrado de 10 ítems por dimensión respondió a criterios de simetría estructural y comparabilidad entre dimensiones, buscando asegurar un análisis psicométrico equilibrado. Si bien la naturaleza de las dimensiones podría haber permitido una extensión o reducción de ítems, se optó por una distribución equitativa inicial como punto de partida para la validación, en línea con prácticas comunes en instrumentos similares (Muñiz y Fonseca-Pedrero, 2019). Posteriormente, el análisis de validez permitió refinar el instrumento, reduciendo el total a 38 ítems en la versión final.

Esta escala permite captar niveles diferenciados de autoevaluación sin sobrecargar la toma de decisiones, y es adecuada para análisis factoriales. La validación del instrumento buscaba garantizar que los indicadores reflejaran adecuadamente la integración de la IA en la educación y las competencias docentes necesarias para su implementación efectiva.

La versión final del cuestionario, compuesta por 38 ítems distribuidos en cuatro dimensiones, puede consultarse íntegramente en el Anexo 1. La inclusión del instrumento completo permite ofrecer una visión detallada de los indicadores empleados para evaluar la competencia docente en IA y favorece su posible replicabilidad en estudios posteriores o programas de formación.

Validación de contenido del instrumento: el método Delphi

La segunda fase del estudio tuvo como objetivo validar el contenido del borrador preliminar del cuestionario previamente elaborado. Para ello, se empleó el método Delphi, ampliamente reconocido en el ámbito de las Ciencias de la Educación por su capacidad para clarificar problemáticas complejas mediante un proceso estructurado de consulta entre expertos organizados en un panel (Reguant-Álvarez y Torrado-Fonseca, 2016). Esta técnica, de naturaleza reiterada, promueve el consenso informado a través de rondas sucesivas de evaluación, permitiendo una convergencia progresiva de opiniones fundamentadas (Linstone y Turoff, 2002; Reguant-Álvarez y Torrado-Fonseca, 2016).

Los instrumentos utilizados para la recolección de datos consistieron en cuestionarios diseñados para valorar dimensiones e ítems específicos, incluyendo apartados para observaciones cualitativas. El proceso de recopilación se organizó con una temporalidad flexible, aunque delimitada, con el fin de facilitar la participación efectiva de un panel de expertos distribuidos geográficamente y con disponibilidad horaria diversa.

En esta etapa, se procedió a la conformación del panel de expertos, priorizando la representatividad y diversidad profesional de los participantes por encima del número absoluto. Para ello, se definieron criterios de selección orientados a garantizar un equilibrio entre el conocimiento actualizado sobre la integración de la Inteligencia Artificial (IA) en contextos educativos y las competencias docentes requeridas para su aplicación efectiva.

Si bien la composición del panel incluyó una mayor proporción de formadores universitarios, esta elección respondió a la necesidad de contar con expertos con una visión sistemática del desarrollo docente y experiencia en formación continua, clave para evaluar competencias transversales como las vinculadas a la IA. No obstante, se aseguró la presencia de profesionales de primaria y secundaria con experiencia directa en la aplicación de tecnologías de IA en el aula, así como de especialistas acreditados en inteligencia artificial con producción científica y participación en proyectos de innovación educativa.

A partir de la estructura preliminar del instrumento, se estableció como criterio central la inclusión de profesionales provenientes de tres perfiles clave: (1) docentes de distintos niveles educativos con experiencia en el uso pedagógico de tecnologías emergentes; (2) especialistas en IA aplicada a la educación; y (3) formadores de docentes en el ámbito de la tecnología educativa. Esta estrategia permitió integrar una perspectiva multidisciplinar coherente con los objetivos del estudio.

Si bien no existe un consenso normativo sobre el tamaño ideal de los paneles Delphi, diversos autores sugieren orientaciones prácticas. En general, se considera que un mínimo de diez participantes asegura la estabilidad del consenso, dado que muestras inferiores a siete pueden comprometer la representatividad (Reguant-Álvarez y Torrado-Fonseca, 2016). En consonancia con esta premisa, Skulmoski et al. (2007) argumentan que, para paneles relativamente homogéneos, una muestra entre diez y quince expertos puede resultar metodológicamente sólida.

Se invitó a participar a doce expertos que cumplían los criterios establecidos. La invitación incluía una caracterización detallada de su perfil profesional, información sobre sus funciones docentes e investigadoras, así como una autoevaluación de su grado de adecuación en relación con el propósito del estudio.

Todos los expertos aceptaron la invitación, conformando un panel con un alto nivel de especialización. El 75 % del grupo contaba con título de doctorado, e incluía siete formadores universitarios en programas de formación docente, tres docentes de educación básica (primaria y secundaria) con experiencia directa en el uso de IA en el aula, y dos especialistas con trayectoria combinada en investigación académica y capacitación docente en IA educativa. Ambos expertos cuentan con publicaciones indexadas sobre IA en educación, han participado como asesores en proyectos de integración tecnológica en instituciones escolares y colaboran en redes internacionales sobre innovación educativa y ética digital.

Además, se procuró una distribución equilibrada por género en la composición del panel, que incluyó 7 mujeres (58 %) y 5 varones (42 %), en línea con los criterios de representatividad y diversidad establecidos en el diseño metodológico.

Entre los criterios comunes de inclusión se encuentran:

- Experiencia mínima de cinco años en tecnología educativa, formación docente o investigación aplicada sobre IA.

- Participación en iniciativas de innovación o proyectos de formación en competencias digitales.

- Representación de distintos niveles del sistema educativo (educación básica y superior)

Composición del panel de expertos Delphi

| Categoría | Cantidad |

| Total de expertos | 12 |

| Con grado de doctorado | 9 |

| Formadores universitarios | 7 |

| Docentes primaria y secundaria | 3 |

| Especialistas en IA y formación docente | 2 |

Las investigadoras responsables supervisaron la recogida de datos durante la fase de validación, llevada a cabo mediante un proceso iterativo de consulta a expertos utilizando el correo electrónico como canal de comunicación principal. El procedimiento se estructuró en dos rondas sucesivas, número considerado adecuado para facilitar la convergencia de opiniones y alcanzar un consenso metodológicamente sólido (Linstone y Turoff, 2002). Desde el inicio, se informó a los participantes sobre esta estructura y el grado de implicación requerido, con el objetivo de garantizar transparencia y compromiso por parte del panel (Reguant-Álvarez y Torrado-Fonseca, 2016).

La primera ronda tuvo como propósito principal la evaluación cuantitativa y cualitativa de los ítems del instrumento, centrando el análisis en dos dimensiones fundamentales: relevancia conceptual y claridad lingüística. A nivel cuantitativo, se solicitó a los expertos que valoraran cada ítem mediante una escala tipo Likert de cinco puntos, donde 1 representaba “nada relevante” o “poco claro”, y 5 indicaba “muy relevante” o “muy claro”. Paralelamente, se habilitaron espacios para comentarios abiertos, lo que permitió recoger sugerencias cualitativas orientadas a mejorar la redacción, precisión o adecuación de los ítems. Este enfoque mixto, sustentado en trabajos previos (Gallant y Luthy, 2020; Grand-Guillaume-Perrenoud et al., 2023; Paulin et al., 2024; Ramírez, 2019; Ramírez-Montoya y Lugo-Ocando, 2020), favorece el enriquecimiento del instrumento desde una perspectiva interpretativa.

A partir del análisis de esta primera fase, se procedió a reformular seis ítems con base en las observaciones cualitativas y se eliminaron dos por considerarse redundantes o conceptualmente débiles. Estos ajustes condujeron al diseño del formulario para la segunda ronda, centrada en la reevaluación de los ítems modificados. Nuevamente, se empleó una escala tipo Likert de cinco puntos para valorar su pertinencia y claridad tras las modificaciones. El objetivo de esta segunda iteración fue confirmar la validez de los cambios introducidos y consolidar una versión final que reflejara el consenso del panel. Los resultados obtenidos permitieron cerrar el proceso con una estructura definitiva compuesta por 38 ítems, distribuidos en cuatro dimensiones teóricas.

El análisis de los resultados de ambas rondas se realizó mediante una combinación de técnicas cuantitativas:

- Estadística descriptiva: cálculo de media, desviación típica y percentiles para cada ítem.

- Coeficiente de concordancia de Kendall (W): utilizado para medir el grado de acuerdo entre los expertos.

- Criterio de aceptación basado en el percentil 80: se estableció como umbral mínimo para considerar aceptados los ítems, de acuerdo con Mauri et al. (2007).

Este enfoque analítico permitió identificar con precisión los ítems que alcanzaron altos niveles de consenso, así como aquellos que requerían ajustes o eliminación.

Aplicación piloto y análisis psicométrico

Una vez finalizado el proceso de validación por juicio de expertos, la versión revisada del instrumento fue sometida a una aplicación piloto con una muestra de 128 docentes procedentes de diversos contextos educativos en España y América Latina. La selección fue intencional, con criterios de accesibilidad y diversidad institucional.

Perfil de la muestra:

- Educación primaria: 34 %

- Educación secundaria: 31 %

- Educación superior: 35 %

- Promedio de experiencia docente: 9,6 años

- Distribución por género: 69 % mujeres, 31 % varones

La aplicación se llevó a cabo en modalidad online. La muestra estuvo compuesta por docentes procedentes de siete países de habla hispana: España (n = 49), México (n = 27), Argentina (n = 18), Colombia (n = 12), Chile (n = 9), Perú (n = 7) y Uruguay (n = 6). Esta distribución respondió a criterios de accesibilidad institucional y diversidad geográfica, garantizando una representación equilibrada de diferentes contextos educativos. En cuanto al nivel educativo, la proporción de participantes se mantuvo similar en cada país, con representación de los tres niveles: educación primaria, secundaria y superior.

Todos los participantes firmaron un consentimiento informado digital antes de acceder al cuestionario. Los datos recopilados fueron procesados mediante los programas IBM SPSS v28 y AMOS v24, y se sometieron a tres tipos de análisis estadísticos:

a) Consistencia interna

La fiabilidad interna del cuestionario se estimó mediante el coeficiente alfa de Cronbach, calculado individualmente para cada dimensión y para el total del instrumento. Este análisis permitió evaluar la coherencia interna de los ítems agrupados en torno a los distintos constructos teóricos:

- Conocimientos generales sobre IA: α = 0.88

- Uso pedagógico de herramientas de IA: α = 0.90

- Ética y consideraciones: α = 0.87

- Integración curricular: α = 0.91

- Total (AI-ED-SAT): α = 0.93

Estos valores reflejan una alta consistencia interna en todas las dimensiones, superando ampliamente el umbral de 0.70 recomendado por la literatura especializada.

Además del coeficiente alfa de Cronbach, se calcularon los coeficientes omega de McDonald, los cuales superaron en todos los casos el umbral de 0.85 (ω total = 0.94). Esta métrica, considerada una estimación más robusta de la fiabilidad en escalas con estructuras multidimensionales (McDonald, 1999), refuerza la evidencia de alta consistencia interna del instrumento. Si bien en esta fase no se aplicaron análisis de fiabilidad temporal (test–retest) ni pruebas de invarianza factorial por subgrupos (nivel educativo, género o país), debido al carácter transversal del diseño y al tamaño muestral, se reconoce la relevancia de estas técnicas para futuras investigaciones de validación con diseños longitudinales o muestras ampliadas.

Aunque el número de participantes puede considerarse ajustado respecto al número total de ítems del instrumento, diversos estudios metodológicos (Costello y Osborne, 2005; Lloret-Segura et al., 2014; MacCallum et al., 1999) coinciden en que la adecuación muestral no depende únicamente del tamaño absoluto, sino de otros factores como la comunalidad de los ítems, el número de factores esperados y la solidez de los indicadores estadísticos. En esta misma línea, Hogarty et al. (2005) señalan que la calidad de las soluciones factoriales se ve más influida por la comunalidad media y la sobredeterminación de los factores que por el tamaño muestral en sí. En este caso, la alta consistencia interna del instrumento (α = 0.93), el índice de adecuación muestral KMO = 0.91, la significación de la prueba de esfericidad de Bartlett, y las cargas factoriales superiores a 0.60 en todos los ítems, permiten considerar la muestra de 128 docentes como metodológicamente sólida para el análisis factorial realizado.

b) Análisis factorial exploratorio (AFE)

Con el fin de identificar la estructura subyacente del cuestionario, se realizó un AFE utilizando el método de máxima verosimilitud y rotación Varimax. La adecuación de la muestra fue confirmada mediante:

- Índice KMO = 0.91

- Prueba de esfericidad de Bartlett: χ² (gl = 703) = 3982.23, p < .001

Ambos indicadores mostraron condiciones excelentes para la aplicación del análisis factorial. Las cargas factoriales fueron superiores a 0.60 en todos los ítems retenidos, y la varianza total explicada alcanzó el 67.8 %, distribuida de forma equilibrada entre las cuatro dimensiones propuestas.

En atención a las recomendaciones metodológicas y con el objetivo de proporcionar una mayor transparencia en los resultados, se incluye como Anexo 2 la matriz completa de cargas factoriales, comunalidades y varianzas específicas correspondientes a los 38 ítems retenidos en el análisis factorial exploratorio. Esta información permite una revisión detallada de la estructura factorial del instrumento y respalda la solidez del modelo obtenido.

c) Análisis factorial confirmatorio (AFC)

Para verificar la adecuación empírica del modelo teórico derivado del AFE, se llevó a cabo un AFC mediante un modelo bifactorial, evaluando la calidad del ajuste a través de los siguientes indicadores:

- χ²/gl = 2.34

- CFI = 0.96

- TLI = 0.95

- RMSEA = 0.045

Todos los valores obtenidos indican un excelente ajuste del modelo factorial, lo que confirma la validez estructural del instrumento AI-ED-SAT como herramienta de autoevaluación docente sobre el uso de la Inteligencia Artificial en entornos educativos.

Aunque lo metodológicamente recomendable es aplicar el AFE y el AFC en muestras independientes, diversos estudios (Brown, 2015; Worthington y Whittaker, 2006; Lloret-Segura et al., 2014) reconocen que en contextos de investigación aplicada con muestras limitadas es aceptable aplicar ambos procedimientos sobre la misma muestra, siempre que los resultados estadísticos sean sólidos y se explicite la limitación. En este estudio, se ha optado por esta estrategia con fines exploratorios y de validación inicial, reconociendo la necesidad de replicación futura en contextos más amplios.

RESULTADOS

Validación por juicio de expertos (método Delphi) y análisis deconcordancia

Durante la primera ronda del método Delphi, los 40 ítems que componían el cuestionario fueron evaluados por el panel de expertos en relación con dos aspectos fundamentales: la relevancia conceptual y la claridad lingüística. Aunque la mayoría de los ítems obtuvieron valoraciones elevadas, seis fueron reformulados y dos eliminados por no alcanzar el umbral mínimo establecido del percentil 80 % en la dimensión de relevancia.

En la segunda ronda, los expertos reevaluaron los ítems ajustados. Los resultados fueron analizados mediante el coeficiente de concordancia de Kendall (W), cuyos valores mostraron un nivel de acuerdo estadísticamente significativo en ambas dimensiones evaluadas. Este hallazgo respalda la existencia de consenso entre los expertos, incluso considerando la diversidad de perfiles y enfoques.

Concordancia entre expertos – Coeficiente de Kendall

| Aspecto evaluado | W de Kendall | Chi-cuadrado | gl | Sig. (p) |

| Relevancia | 0.27 | 84.44 | 26 | < .001 |

| Claridad | 0.24 | 74.53 | 26 | < .001 |

Para garantizar la validez de contenido, se aplicó el enfoque de Mauri et al. (2007), adaptando el punto de corte al percentil 80 % en lugar de la media aritmética. Adicionalmente, se estableció una relación condicional entre relevancia y claridad: la claridad de un ítem solo era evaluada si este había sido considerado previamente como relevante. De esta manera, se evitó valorar ítems conceptualmente débiles desde el punto de vista formal. Los coeficientes de concordancia obtenidos reflejan un consenso adecuado, lo cual justifica la incorporación de los ítems reformulados y la exclusión de aquellos que no alcanzaron los criterios establecidos.

Aunque los coeficientes de Kendall se sitúan en niveles moderados (W = 0,27 para relevancia y W = 0,24 para claridad), estos valores son consistentes con la naturaleza diversa del panel de expertos y el enfoque cualitativo complementario del método Delphi. En estudios previos, se ha señalado que niveles de concordancia intermedios pueden ser metodológicamente aceptables en paneles heterogéneos, especialmente cuando se combinan con análisis cualitativos que enriquecen la interpretación y permiten ajustes fundados en los ítems (Grand-Guillaume-Perrenoud et al., 2023; Reguant-Álvarez y Torrado-Fonseca, 2016). Por tanto, la magnitud de W refleja un equilibrio razonable entre diversidad de perspectivas y consenso suficiente para sustentar la validez de contenido del instrumento.

Consistencia interna

El análisis de fiabilidad interna se realizó sobre la muestra piloto (N = 128 docentes) mediante el coeficiente alfa de Cronbach, tanto para las dimensiones individuales como para el total del instrumento. Todos los coeficientes superaron ampliamente el valor de referencia de 0.85, lo que indica una alta consistencia interna entre los ítems de cada dimensión y del conjunto del cuestionario:

Consistencia interna (alfa de Cronbach)

| Dimensión |

Alfa de Cronbach |

| Conocimientos generales sobre IA | 0.88 |

| Uso pedagógico de la IA | 0.9 |

| Ética y consideraciones | 0.87 |

| Integración curricular de la IA | 0.91 |

| Total AI-ED-SAT | 0.93 |

Además del análisis de consistencia interna, se calcularon estadísticas descriptivas de las puntuaciones obtenidas en la prueba piloto. Las medias por dimensión oscilaron entre 3.2 y 4.1 (en una escala Likert de 1 a 5), lo que indica una percepción general positiva por parte del profesorado. La dimensión con mayor puntuación fue “Uso pedagógico de la IA” (M = 4.1, SD = 0.6), seguida de “Conocimientos generales sobre IA” (M = 3.8, SD = 0.7). Las dimensiones “Integración curricular” y “Ética y consideraciones” presentaron medias de 3.5 (SD = 0.8) y 3.2 (SD = 0.9), respectivamente, lo que sugiere áreas con mayor margen de desarrollo profesional docente.

Este resultado respalda la coherencia interna del instrumento y confirma que los ítems se agrupan de manera lógica y consistente dentro de sus respectivos constructos.

Análisis factorial exploratorio (AFE)

Para explorar la estructura subyacente del cuestionario, se llevó a cabo un análisis factorial exploratorio (AFE) utilizando el método de máxima verosimilitud con rotación Varimax. La adecuación muestral fue excelente (KMO = 0.91) y la prueba de esfericidad de Bartlett resultó significativa (χ² (gl = 703) = 3982.23, p < .001), lo que justificó la aplicación del modelo factorial.

Considerando la diversidad geográfica de la muestra, se prestó especial atención a las posibles diferencias léxicas y de uso del español entre España y América Latina. Durante el diseño de los ítems se evitó el empleo de expresiones idiomáticas o tecnicismos regionales, priorizando un lenguaje claro, neutro y accesible. Tanto en la fase Delphi como en la prueba piloto se incluyeron espacios para observaciones lingüísticas, que fueron analizadas cualitativamente y, en caso necesario, condujeron a la reformulación de términos con potencial ambigüedad. Este cuidado contribuyó a mejorar la validez semántica del instrumento y su aplicabilidad en contextos educativos hispanohablantes diversos.

El AFE reveló cuatro factores principales, en correspondencia con la estructura teórica propuesta, que explicaron conjuntamente el 67.8 % de la varianza total. Las cargas factoriales se mantuvieron por encima de 0.60 en todas las dimensiones, lo que confirmó un nivel adecuado de saturación de los ítems en sus respectivos factores.

Durante este proceso, se trabajó con los 40 ítems originales. Para la presentación en la Tabla 4 se seleccionó un conjunto reducido de 10 ítems representativos (2-3 por dimensión) con el objetivo de ilustrar de manera sintética las cargas factoriales más destacadas y facilitar la lectura. La matriz completa, que incluye los 38 ítems definitivos tras los ajustes de redacción y depuración estadística, junto con sus comunalidades y varianzas específicas, se presenta en el Anexo 2.

Cargas factoriales de ítems seleccionados (AFE)

| Ítem |

Carga factorial (AFE) |

| Ítem 1 | 0.72 |

| Ítem 2 | 0.81 |

| Ítem 3 | 0.75 |

| Ítem 4 | 0.77 |

| Ítem 5 | 0.8 |

| Ítem 6 | 0.69 |

| Ítem 7 | 0.73 |

| Ítem 8 | 0.78 |

| Ítem 9 | 0.74 |

| Ítem 10 | 0.82 |

Estos resultados evidencian que los ítems seleccionados mantienen una estructura clara y coherente en cada dimensión, y son representativos del patrón factorial obtenido para el conjunto del instrumento.

Análisis factorial confirmatorio (AFC)

Con el objetivo de confirmar empíricamente la validez estructural del cuestionario, se aplicó un análisis factorial confirmatorio (AFC) sobre el modelo teórico derivado del AFE. El modelo evaluado fue de tipo bifactorial, lo cual permitió verificar tanto la varianza común general como la varianza específica atribuible a cada dimensión.

Los indicadores de ajuste obtenidos fueron:

- χ²/gl = 2.34

- CFI = 0.96

- TLI = 0.95

- RMSEA = 0.045

Estos valores se encuentran dentro de los rangos establecidos como indicadores de excelente ajuste (Hu y Bentler, 1999), lo cual confirma que la estructura del instrumento AI-ED-SAT refleja adecuadamente el modelo teórico propuesto. En concreto, el índice CFI (Comparative Fit Index) y el TLI (Tucker-Lewis Index) superan el umbral de 0.95, mientras que el RMSEA se mantiene por debajo de 0.06, lo que respalda la validez del modelo desde una perspectiva multidimensional.

Este análisis proporciona evidencia sólida de que el cuestionario cuenta con una estructura factorial robusta, capaz de capturar de manera precisa los cuatro componentes teóricos planteados: conocimientos sobre IA, uso pedagógico, ética y consideraciones, e integración curricular.

En coherencia con el proceso metodológico basado en el método Delphi, y con el objetivo de garantizar la claridad, pertinencia y coherencia teórica de los ítems, se realizó una depuración del instrumento tras el análisis cualitativo y cuantitativo de las rondas de validación. En este proceso, se eliminaron dos ítems por no alcanzar el umbral de relevancia establecido y se reformularon seis más debido a problemas de claridad, ambigüedad o adecuación al perfil docente. La Tabla 5 presenta el resumen de las acciones realizadas sobre los ítems durante esta fase de revisión experta.

Ítems eliminados y reformulados tras proceso Delphi

| Ítem original | Acción tomada | Justificación |

Nueva versión (si aplica) |

| Ítem 5 – “Comprendo los fundamentos matemáticos y lógicos de la IA”. | Eliminado | Bajo nivel de relevancia para el perfil docente general; contenido excesivamente técnico; no superó el percentil 80 %. | — |

| Ítem 12 – “He diseñado actividades de aprendizaje que incorporan IA”. | Eliminado | Nivel de implementación poco común en el perfil docente medio; baja relevancia percibida por los expertos. | — |

| Ítem 4 – “Estoy familiarizado con términos como aprendizaje automático y redes neuronales”. | Reformulado | Lenguaje técnico sin suficiente claridad; se sugiere redacción más accesible. | Estoy familiarizado con términos generales relacionados con la IA, como “aprendizaje automático” o “redes neuronales”. |

| Ítem 7 – “Puedo explicar a otros docentes cómo funciona la IA básica”. | Reformulado | Ambigüedad en el término “IA básica”; necesidad de mayor precisión. | Puedo explicar de forma sencilla a otros docentes los conceptos fundamentales de la IA. |

| Ítem 16 – “Uso chatbots o asistentes virtuales para responder dudas de los estudiantes”. | Reformulado | Ambigüedad técnica y diversidad de interpretación; redacción imprecisa. | Utilizo herramientas como chatbots o asistentes virtuales para apoyar la resolución de dudas de los estudiantes. |

| Ítem 27 – “Identifico los impactos sociales de la IA en la educación”. | Reformulado | Ítem demasiado amplio; se recomienda especificar el enfoque. | Identifico cómo la IA puede afectar el acceso, la equidad y la interacción social en contextos educativos. |

| Ítem 33 – “Conozco marcos curriculares que incorporan IA en la educación”. | Reformulado | Ambigüedad sobre la disponibilidad de marcos; contexto poco generalizable. | Conozco ejemplos de propuestas curriculares o políticas que promueven la inclusión de la IA en la educación. |

| Ítem 36 – “Uso simulaciones basadas en IA para reforzar conceptos en el aula”. | Reformulado | Terminología poco clara; se sugiere redacción más práctica y concreta. | Empleo simulaciones o herramientas interactivas apoyadas en IA para reforzar el aprendizaje de los estudiantes. |

DISCUSIÓN

Los resultados obtenidos en la validación del instrumento AI-ED-SAT confirman la solidez conceptual y psicométrica de su diseño, lo que permite considerarlo una herramienta robusta para evaluar la competencia docente en torno al uso de la Inteligencia Artificial (IA) en entornos educativos. En línea con los marcos de referencia propuestos por organismos internacionales como la UNESCO (2021) y la OCDE (2022), el cuestionario ofrece una aproximación integral, actualizada y contextualizada a las exigencias formativas de los docentes frente al auge de la IA en el ámbito educativo.

La elevada consistencia interna obtenida en todas las dimensiones (α de Cronbach entre 0.87 y 0.93) respalda la coherencia interna de los ítems en torno a constructos bien definidos. Asimismo, tanto el análisis factorial exploratorio (AFE) como el análisis factorial confirmatorio (AFC) ofrecieron evidencia empírica clara de la validez estructural del modelo propuesto, con indicadores de ajuste (CFI = 0.96; RMSEA = 0.045) que superan ampliamente los estándares mínimos exigidos en la literatura psicométrica (Hu y Bentler, 1999). Estos hallazgos sustentan que el AI-ED-SAT evalúa dimensiones diferenciadas y complementarias del conocimiento y práctica docente en relación con la IA.

Más allá de los indicadores psicométricos, los resultados subrayan la pertinencia del AI-ED-SAT como herramienta diagnóstica y formativa en un contexto donde la alfabetización docente en IA se vuelve estratégica. Tal como advierten Celik (2023), el desarrollo de competencias docentes en IA debe ir más allá del manejo técnico de herramientas, abarcando también la capacidad de análisis crítico, diseño pedagógico significativo y adaptación curricular a los nuevos escenarios tecnológicos. El instrumento responde a esta necesidad al integrar cuatro dimensiones clave: comprensión conceptual, uso pedagógico, enfoque ético e integración curricular. Esta segmentación no solo resulta coherente con estudios previos (Chen et al., 2020; Zawacki-Richter et al., 2019), sino que permite ofrecer retroalimentación diferenciada y específica, lo cual es altamente valioso para orientar procesos de desarrollo profesional docente.

Potencial del AI-ED-SAT para la formación docente universitaria en entornos digitales e híbridos

La creciente incorporación de modalidades digitales e híbridas en la educación superior exige que la formación docente universitaria integre competencias específicas para la enseñanza mediada por tecnologías emergentes, incluyendo la Inteligencia Artificial. El AI-ED-SAT, por su estructura en cuatro dimensiones y su carácter autorreflexivo, ofrece un marco operativo para diagnosticar y desarrollar dichas competencias en contextos académicos diversos. En entornos digitales, sus resultados pueden orientar la selección de recursos, estrategias y enfoques pedagógicos basados en IA, promoviendo la adaptación de contenidos y metodologías a la virtualidad. En modalidades híbridas, el instrumento facilita la identificación de prácticas que integren de manera coherente las potencialidades de la IA tanto en el aula física como en entornos virtuales, favoreciendo la coherencia pedagógica y la inclusión digital. Su aplicación en programas de desarrollo profesional universitario permite, además, diseñar itinerarios formativos personalizados y vinculados a evidencias, potenciando el aprendizaje adaptativo y la actualización continua del profesorado frente a los avances tecnológicos.

Una de las fortalezas distintivas del instrumento reside en su formato de autoevaluación, que estimula la reflexión personal y posiciona al docente como protagonista activo de su formación continua. A diferencia de modelos evaluativos centrados en competencias digitales genéricas, el AI-ED-SAT se focaliza en una tecnología específica —la IA— y en su uso pedagógico contextualizado, lo que representa una contribución innovadora y necesaria frente a la rápida integración de sistemas de IA en plataformas educativas, entornos virtuales de aprendizaje y dispositivos de evaluación automatizada (Baltazar, 2023; Owan et al., 2023).

Desde el punto de vista metodológico, la combinación del enfoque Design-Based Research (DBR) con la técnica Delphi aportó rigor, flexibilidad y sensibilidad contextual en la construcción del instrumento. Este enfoque permitió un desarrollo iterativo y consensuado, articulando la fundamentación teórica con la validación práctica a través de la experiencia de un panel de expertos. Investigaciones previas han respaldado la eficacia de esta combinación metodológica en el desarrollo de instrumentos educativos complejos (Diefes-Dux et al., 2010; Rachbauer et al., 2025), especialmente cuando se requiere equilibrio entre solidez técnica y adecuación pedagógica.

Estos hallazgos son consistentes con estudios previos que han identificado un mayor dominio del profesorado en el uso técnico de herramientas digitales frente a dimensiones éticas o curriculares más complejas (Celik, 2023; Chen et al., 2020). En comparación con instrumentos similares centrados en competencias digitales generales, el AI-ED-SAT presenta medias ligeramente más altas en ítems de aplicación pedagógica específica de la IA. Esta diferencia puede atribuirse al enfoque contextualizado del instrumento, diseñado específicamente para captar percepciones docentes sobre el uso de inteligencia artificial en contextos educativos reales.

A pesar de los resultados prometedores, es importante reconocer ciertas limitaciones metodológicas que condicionan la interpretación de los hallazgos. En primer lugar, la muestra piloto fue seleccionada por conveniencia, lo cual introduce un sesgo potencial y limita la generalización de los resultados a otros contextos educativos. En segundo lugar, el instrumento fue validado exclusivamente en países hispanohablantes, lo que restringe su aplicabilidad intercultural. Estas limitaciones deben tenerse en cuenta al valorar la validez y utilidad del cuestionario en otros entornos formativos.

En este sentido, los resultados deben entenderse como una validación preliminar del instrumento. Se recomienda replicar el estudio en muestras más amplias y diversificadas, especialmente en contextos de educación superior y entornos virtuales de aprendizaje, con el fin de fortalecer la generalización de los hallazgos y afinar la sensibilidad del instrumento ante diferentes realidades educativas.

CONCLUSIONES

El desarrollo y validación del cuestionario AI-ED-SAT representa una contribución significativa al campo de la innovación educativa y la formación docente, al ofrecer una herramienta rigurosa, pertinente y actualizada para la autoevaluación de competencias profesionales vinculadas al uso de la Inteligencia Artificial (IA) en contextos escolares. Su diseño se fundamenta en un enfoque teórico robusto, una construcción participativa basada en el consenso experto y un proceso de validación psicométrica exhaustivo, lo que garantiza su utilidad tanto para la investigación como para procesos de mejora formativa.

Entre las principales aportaciones del instrumento destacan:

- La estructuración en cuatro dimensiones clave —comprensión conceptual, aplicación pedagógica, enfoque ético e integración curricular— que reflejan de forma integrada los desafíos actuales que enfrenta la práctica docente frente al avance de la IA.

- Su carácter formativo y autorreflexivo, permite a los docentes identificar fortalezas, áreas de mejora y necesidades de desarrollo profesional de forma autónoma y situada.

- La versatilidad de uso en diversos contextos formativos, tanto presenciales como virtuales, lo que lo convierte en una herramienta adaptable a programas de capacitación inicial y continua, con potencial para personalizar itinerarios de formación.

Además de sus aportes inmediatos, el AI-ED-SAT abre diversas líneas de investigación y desarrollo futuro, entre las que se recomienda:

- Ampliar su validación empírica con muestras más extensas, representativas y culturalmente diversas.

- Realizar análisis de invarianza factorial para comprobar la estabilidad de su estructura en diferentes niveles educativos, regiones geográficas o grupos de docentes con perfiles heterogéneos.

- Desarrollar versiones adaptadas lingüística y culturalmente para contextos no hispanohablantes, considerando tanto la traducción técnica como la adecuación semántica.

- Integrar el cuestionario en plataformas digitales de formación docente, en las que los resultados puedan vincularse con rutas de aprendizaje adaptativas, promoviendo una retroalimentación formativa automatizada.

En un escenario global en el que la IA no solo redefine los métodos de enseñanza y aprendizaje, sino también los marcos éticos, sociales y políticos que sustentan la toma de decisiones educativas, se vuelve urgente dotar al profesorado de instrumentos que faciliten su alfabetización crítica, autonomía profesional y agencia transformadora. En este sentido, el AI-ED-SAT aspira a ser mucho más que un instrumento de medición: busca convertirse en un catalizador de reflexión, empoderamiento y compromiso ético del docente frente a los desafíos tecnológicos del siglo XXI.

REFERENCIAS

Alier Forment, M., García Peñalvo, F. J., Casañ Guerrero, M. J., Pereira, J. A. y Llorens-Largo, F. (2024, 8 de octubre). Safe AI in Education Manifesto (Version 0.4.0). Safe AI in Education Manifesto. https://manifesto.safeaieducation.org

Ayuso del Puerto, D. y Gutiérrez Esteban, P. (2022). La inteligencia artificial como recurso educativo durante la formación inicial del profesorado. RIED-Revista Iberoamericana de Educación a Distancia, 25(2), 347-362. https://doi.org/10.5944/ried.25.2.32332

Baltazar, C. (2023). Herramientas de IA aplicables a la educación. Technology Rain Journal, 2(2), e15-e15. https://doi.org/10.55204/trj.v2i2.e15

Bo, N. S. W. (2024). OECD digital education outlook 2023: Towards an effective education ecosystem. Hungarian Educational Research Journal, 15(2), 284-289. https://doi.org/10.1556/063.2024.00340

Borge, R., García, J., Oliver, R. y Salomón, L. (2005). Competencias y diseño de la evaluación continua y final en el Espacio Europeo de Educación Superior. Dirección General de Universidades, MEC.

Brown, A. L. (1992). Design experiments: Theoretical and methodological challenges in creating complex interventions in classroom settings. Journal of the Learning Sciences, 2(2), 141-178. https://doi.org/10.1207/s15327809jls0202_2

Brown, T. A. (2015). Confirmatory factor analysis for applied research (2ª ed.). The Guilford Press.

Cabero-Almenara, J., Barroso-Osuna, J., Palacios-Rodríguez, A. y Llorente-Cejudo, C. (2020). Marcos de competencias digitales para docentes universitarios: Su evaluación a través del coeficiente competencia experta. Revista Electrónica Interuniversitaria de Formación del Profesorado, 23(3), 17–34. https://doi.org/10.6018/reifop.414501

Caena, F. y Redecker, C. (2019). Aligning teacher competence frameworks to 21st century challenges: The case for the European Digital Competence Framework for Educators (DigCompEdu). European Journal of Education, 54(3), 356-369. https://doi.org/10.1111/ejed.12345

Celik, I. (2023). Towards Intelligent-TPACK: An empirical study on teachers’ professional knowledge to ethically integrate artificial intelligence (AI)-based tools into education. Computers in Human Behavior, 138, 107468. https://doi.org/10.1016/j.chb.2022.107468

Chen, L., Chen, P. y Lin, Z. (2020). Artificial intelligence in education: A review. IEEE Access, 8, 75264-75278. https://doi.org/10.1109/ACCESS.2020.2988510

Chesterman, S. (2021). Through a glass, darkly: Artificial intelligence and the problem of opacity. The American Journal of Comparative Law, 69(2), 271-294. https://doi.org/10.1093/ajcl/avab012

Chiu, T. K., Ahmad, Z., Ismailov, M. y Sanusi, I. T. (2024). What are artificial intelligence literacy and competency? A comprehensive framework to support them. Computers and Education Open, 6, 100171. https://doi.org/10.1016/j.caeo.2024.100171

Costello, A. B. y Osborne, J. W. (2005). Best practices in exploratory factor analysis: Four recommendations for getting the most from your analysis. Practical Assessment, Research, and Evaluation, 10(1), 1-9. https://doi.org/10.7275/jyj1-4868

Delgado, N., Carrasco, L. C., de la Maza, M. S. y Etxabe-Urbieta, J. M. (2024). Aplicación de la inteligencia artificial (IA) en educación: Los beneficios y limitaciones de la IA percibidos por el profesorado de educación primaria, educación secundaria y educación superior. Revista Electrónica Interuniversitaria de Formación del Profesorado, 27(1), 207-224. https://doi.org/10.6018/reifop.577211

Diefes-Dux, H. A., Zawojewski, J. S. y Hjalmarson, M. A. (2010). Using educational research in the design of evaluation tools for open-ended problems. International Journal of Engineering Education, 26(4), 807-819.

Ferrante, E. (2021). Inteligencia artificial y sesgos algorítmicos: ¿Por qué deberían importarnos? Nueva Sociedad, (294), 27-36. https://nuso.org/articulo/inteligencia-artificial-y-sesgos-algoritmicos/

Flores Vivar, J. M. y García Peñalvo, F. J. (2023). Reflexiones sobre la ética, potencialidades y retos de la inteligencia artificial en el marco de la Educación de Calidad (ODS4). Comunicar: Revista Científica de Comunicación y Educación, (74), 37-47. https://doi.org/10.3916/C74-2023-03

Gallant, D. J. y Luthy, N. (2020). Mixed methods research in designing an instrument for consumer-oriented evaluation. Journal of MultiDisciplinary Evaluation, 16(34), 21-43. https://doi.org/10.56645/jmde.v16i34.583

García Peñalvo, F. J., Llorens-Largo, F. y Vidal, J. (2024). La nueva realidad de la educación ante los avances de la inteligencia artificial generativa. RIED-Revista Iberoamericana de Educación a Distancia, 27(1), 9-39. https://doi.org/10.5944/ried.27.1.37716

Ghomi, M. y Redecker, C. (2019, mayo). Digital competence of educators (DigCompEdu): Development and evaluation of a self-assessment instrument for teachers’ digital competence. En Proceedings of the 11th International Conference on Computer Supported Education (CSEDU 2019) (Vol. 1, pp. 541-548). SCITEPRESS. https://doi.org/10.5220/0007679005410548

Grand-Guillaume-Perrenoud, J. A., Geese, F., Uhlmann, K., Blasimann, A., Wagner, F. L., Neubauer, F. B., Huwendiek, S., Hahn, S. y Schmitt, K.-U. (2023). Mixed methods instrument validation: Evaluation procedures for practitioners developed from the validation of the Swiss Instrument for Evaluating Interprofessional Collaboration. BMC Health Services Research, 23, 83. https://doi.org/10.1186/s12913-023-09040-3

Hernández-Sampieri, R., Fernández-Collado, C. y Baptista-Lucio, P. (2006). Metodología de la investigación (4ª ed.). McGraw-Hill Interamericana.

Hogarty, K. Y., Hines, C. V., Kromrey, J. D., Ferron, J. M. y Mumford, K. R. (2005). The quality of factor solutions in exploratory factor analysis: The influence of sample size, communality, and overdetermination. Educational and Psychological Measurement, 65(2), 202-226. https://doi.org/10.1177/0013164404267287

Holmes, W., Bialik, M. y Fadel, C. (2019). Artificial intelligence in education: Promises and implications for teaching and learning. Center for Curriculum Redesign.

Holmes, W. y Tuomi, I. (2022). State of the art and practice in AI in education. European Journal of Education, 57(4), 542-570. https://doi.org/10.1111/ejed.12533

Hu, L. T. y Bentler, P. M. (1999). Cutoff criteria for fit indexes in covariance structure analysis: Conventional criteria versus new alternatives. Structural Equation Modeling: A Multidisciplinary Journal, 6(1), 1-55. https://doi.org/10.1080/10705519909540118

Huang, L. (2023). Ethics of artificial intelligence in education: Student privacy and data protection. Science Insights Education Frontiers, 16(2), 2577-2587. https://doi.org/10.15354/sief.23.re202

Khreisat, M. N., Khilani, D., Rusho, M. A., Karkkulainen, E. A., Tabuena, A. C. y Uberas, A. D. (2024). Ethical implications of AI integration in educational decision making: Systematic review. Educational Administration: Theory and Practice, 30(5), 8521-8527. https://doi.org/10.53555/kuey.v30i5.4406

Lane, M., Williams, M. y Broecke, S. (2023). The impact of AI on the workplace: Main findings from the OECD AI surveys of employers and workers (OECD Social, Employment and Migration Working Papers, No. 288). OECD Publishing. https://doi.org/10.1787/ea0a0fe1-en

Linstone, H. A. y Turoff, M. (Eds.). (2002). The Delphi method: Techniques and applications. Addison-Wesley.

Lloret-Segura, S., Ferreres-Traver, A., Hernández-Baeza, A. y Tomás-Marco, I. (2014). El análisis factorial exploratorio de los ítems: Una guía práctica, revisada y actualizada. Anales de Psicología, 30(3), 1151-1169. https://doi.org/10.6018/analesps.30.3.199361

Luckin, R. (2017). Towards artificial intelligence-based assessment systems. Nature Human Behaviour, 1(3), 0028. https://doi.org/10.1038/s41562-016-0028

MacCallum, R. C., Widaman, K. F., Zhang, S. y Hong, S. (1999). Sample size in factor analysis. Psychological Methods, 4(1), 84-99. https://doi.org/10.1037/1082-989X.4.1.84

Mauri, T., Coll, C. y Onrubia, J. (2007). La evaluación de la calidad de los procesos de innovación docente universitaria: Una perspectiva constructivista. Revista de Docencia Universitaria, 5(1). https://doi.org/10.4995/redu.2007.6290

McDonald, R. P. (1999). Test theory: A unified treatment. Lawrence Erlbaum Associates. https://doi.org/10.4324/9781410601087

Muñiz, J. y Fonseca-Pedrero, E. (2019). Diez pasos para la construcción de un test. Psicothema, 31(1), 7–16. https://doi.org/10.7334/psicothema2018.291

Ng, D. T. K., Leung, J. K. L., Su, J., Ng, R. C. W. y Chu, S. K. W. (2023). Teachers’ AI digital competencies and twenty-first century skills in the post-pandemic world. Educational Technology Research and Development, 71(1), 137-161. https://doi.org/10.1007/s11423-023-10203-6

OECD. (2022). Trends shaping education 2022. OECD Publishing. https://doi.org/10.1787/6ae8771a-en

Owan, V. J., Abang, K. B., Idika, D. O., Etta, E. O. y Bassey, B. A. (2023). Exploring the potential of artificial intelligence tools in educational measurement and assessment. Eurasia Journal of Mathematics, Science and Technology Education, 19(8), em2307. https://doi.org/10.29333/ejmste/13428

Panadero, E., Broadbent, J., Boud, D. y Lodge, J. M. (2019). Using formative assessment to influence self- and co-regulated learning: The role of evaluative judgement. European Journal of Psychology of Education, 34, 535-557. https://doi.org/10.1007/s10212-018-0407-8

Paulin, A. M., Barriga-Arceo, F. D., Mendiola, M. S. y González, A. M. (2024). Evidencias de validez de un instrumento para evaluar la competencia digital docente en educación médica. Investigación en Educación Médica, 13(51), 82-92. https://doi.org/10.22201/fm.20075057e.2024.51.23584

Rachbauer, T., Graup, J. y Rutter, E. (2025). Digital literacy and artificial intelligence literacy in teacher training. Forum for Education Studies, 3(1), 1842. https://doi.org/10.59400/fes1842

Ramírez, J. L. M. (2019). El proceso de elaboración y validación de un instrumento de medición documental. Acción y Reflexión Educativa, 44, 50-63. https://revistas.up.ac.pa/index.php/accion_reflexion_educativa/article/view/673

Ramírez-Montoya, M. S. y Lugo-Ocando, J. (2020). Revisión sistemática de métodos mixtos en el marco de la innovación educativa. Comunicar: Revista Científica de Comunicación y Educación, 28(65), 9–20. https://doi.org/10.3916/C65-2020-01

Reguant-Álvarez, M. y Torrado-Fonseca, M. (2016). El método Delphi. REIRE. Revista d’Innovació i Recerca en Educació, 9(1), 87-102. https://doi.org/10.1344/reire2016.9.1916

Sampieri, R. H. (2018). Metodología de la investigación: Las rutas cuantitativa, cualitativa y mixta. McGraw-Hill México.

Selwyn, N. (2019). Should robots replace teachers? AI and the future of education. John Wiley & Sons.

Sharma, D. M., Ramana, K. V., Jothilakshmi, R., Verma, R., Maheswari, B. U. y Boopathi, S. (2024). Integrating generative AI into K-12 curriculums and pedagogies in India: Opportunities and challenges. En M. S. P. Subathra y G. V. S. N. R. V. Prasad (Eds.), Facilitating global collaboration and knowledge sharing in higher education with generative AI (pp. 133-161). IGI Global. https://doi.org/10.4018/979-8-3693-0487-7.ch006

Skulmoski, G. J., Hartman, F. T. y Krahn, J. (2007). The Delphi method for graduate research. Journal of Information Technology Education: Research, 6(1), 1-21. https://doi.org/10.28945/199

UNESCO. (2021). Artificial intelligence and the futures of learning: Towards an ethical and inclusive approach. UNESCO. https://www.unesco.org/en/digital-education/ai-future-learning

UNESCO. (2023). Generative AI and the future of education. UNESCO. https://doi.org/10.54675/HOXG8740

UNESCO. (2024a). AI competency framework for students. UNESCO. https://doi.org/10.54675/JKJB9835

UNESCO. (2024b). AI competency framework for teachers. UNESCO. https://doi.org/10.54675/ZJTE2084

Worthington, R. L. y Whittaker, T. A. (2006). Scale development research: A content analysis and recommendations for best practices. The Counseling Psychologist, 34(6), 806-838. https://doi.org/10.1177/0011000006288127

Zawacki-Richter, O., Marín, V. I., Bond, M. y Gouverneur, F. (2019). Systematic review of research on artificial intelligence applications in higher education. International Journal of Educational Technology in Higher Education, 16(1), 1-27. https://doi.org/10.1186/s41239-019-0171-0

ANEXO 1

Instrumento AI-ED-SAT: Primera versión

Dimensión 1: Conocimientos generales sobre IA y su aplicación educativa

1. Conozco los conceptos básicos de IA y sus aplicaciones en distintos sectores.

2. Entiendo cómo la IA puede influir en la educación y el aprendizaje.

3. Puedo identificar herramientas de IA aplicables en el ámbito educativo.

4. Estoy familiarizado con términos como aprendizaje automático y redes neuronales.

5. Comprendo los fundamentos matemáticos y lógicos de la IA.

6. Distingo entre diferentes tipos de IA y sus aplicaciones en educación.

7. Puedo explicar a otros docentes cómo funciona la IA básica.

8. Conozco ejemplos de IA utilizada en plataformas de aprendizaje.

9. Identifico ventajas y limitaciones de la IA en el contexto educativo.

10. He investigado sobre tendencias actuales en IA aplicada a la educación.

Dimensión 2: Uso pedagógico de herramientas de IA

11. Utilizo herramientas de IA para mejorar mi práctica docente.

12. He diseñado actividades de aprendizaje que incorporan IA.

13. Conozco plataformas de IA que pueden apoyar la enseñanza personalizada.

14. Evalúo el impacto de las herramientas de IA en el aprendizaje de mis estudiantes.

15. Aplico la IA para la generación de materiales didácticos.

16. Uso chatbots o asistentes virtuales para responder dudas de los estudiantes.

17. Implemento IA para la evaluación automática de tareas.

18. Exploro herramientas de IA que promuevan el aprendizaje adaptativo.

19. Desarrollo estrategias para integrar la IA en actividades colaborativas.

20. Participo en formaciones sobre nuevas herramientas de IA en educación.

Dimensión 3: Ética y consideraciones sobre IA en el aula

21. Soy consciente de los posibles sesgos en los sistemas de IA.

22. Promuevo el uso ético y responsable de la IA en el aula.

23. Enseño a mis estudiantes sobre privacidad y seguridad en el uso de la IA.

24. Reflexiono sobre los desafíos éticos de la automatización en la educación.

25. Analizo cómo la IA puede influir en la toma de decisiones.

26. Discuto con los estudiantes los problemas de transparencia en los algoritmos de IA.

27. Identifico los impactos sociales de la IA en la educación.

28. Propongo prácticas para garantizar el uso equitativo de la IA.

29. Investigo sobre regulaciones y normativas de IA en educación.

30. Facilito espacios de reflexión sobre el impacto de la IA en la sociedad.

Dimensión 4: Integración curricular de la IA

31. He integrado actividades relacionadas con la IA en mis planes de estudio.

32. Diseño estrategias didácticas que incluyen IA como herramienta de aprendizaje.

33. Conozco marcos curriculares que incorporan IA en la educación.

34. Participo en formaciones sobre IA aplicada a la enseñanza.

35. Desarrollo proyectos interdisciplinarios en los que incluyo IA.

36. Uso simulaciones basadas en IA para reforzar conceptos en el aula.

37. Coordino actividades con otros docentes para integrar IA en el currículo.

38. Investigo metodologías activas que emplean IA en el aula. 3

39. Diseño unidades didácticas completas centradas en IA.

40. Promuevo la alfabetización en IA entre mis estudiantes.

ANEXO 2